Полагаю, что нет такого сеошника, который бы хоть раз в жизни не делал аудит сайта. Однако, аудит аудиту – рознь, так как у каждого SEO-специалиста / рекламного агентства существуют свои правила составления аудита, поэтому в этой статье я хочу рассмотреть классический аудит сайта, который делают SEO-компании, при этом он не будет содержать 100500 страниц «воды», разделов «Наши награды / Клиенты / Словарь терминов» и прочей ненужной информации.

3

показа

84K

открытий

3

репоста

Сегодня мы по шагам проведем аудит сайта, который будет содержать порядка 15 страниц и в результате которого вы сможете проводить технические аудиты самостоятельно, используя шаблон, приложенный к данной статье.

Скачать шаблон аудита в формате Microsoft Word можно по ссылке, размещенной в конце данного материала.

Мясо, дайте мне мясо!

Зачастую аудиты составляют по неким шаблонам, скачанным из интернета, либо разработанным в рекламных агентствах, в которых непосредственно работает SEO-оптимизатор. В своей практике работы сеошником я встречал аудиты, проведенные как на 3-х страницах, так и содержащие более 30 страниц, при этом довольно часто пользы от них было примерно одинаково. В результате, такие аудиты уходят «в стол», а работы по оптимизации сайта так и не воплощаются в жизнь.

А все потому, что есть несколько проблем, из-за которых подобные рекомендации так и не внедряют на сайт:

-

Непродуманная структура.

-

Безалаберное оформление.

-

Избыточная информация (по-простому, «вода).

Непродуманная структура

При непродуманной структуре, когда все параметры пишутся по памяти «как придет в голову» аудит сложно воспринимается, поэтому логично разбивать аудит на секции, как то: Технический аудит, Внутренняя оптимизация, Внешняя оптимизация, Юзабилити-аудит и т.п.

Безалаберное оформление

По оформлению аудита клиент судит и о профессионализме самой компании. Если аудит оформлен небрежно (нет единого стиля для заголовков, подзаголовков, списков, отсутствие изображений с примерами и т.д.), то в таком случае резонно, что под сомнение ставится и само качество работы. Как говорится в известной пословице: «Встречают по одёжке, а провожают по уму». То есть, в некоторых случаях, до проводов дело может и не дойти.

Избыточная информация

Многие аудиты, особенно от крупных рекламных агентств, делаются автоматически, используя внутренние сервисы с минимальным участием SEO-специалиста. В таком случае их объем может занимать более 30 страниц, при этом действительно важной информации будет всего на 2-3 страницы (в зависимости состояния исследуемого сайта). Поэтому, после анализа заказчиком подобных аудитов, его сотрудникам приходится делать отдельный аудит, содержащий только необходимые доработки по сайту. Согласитесь, двойная работа мало кого может вдохновить, а дело до внедрения рекомендаций может так и не дойти.

Таким образом, мы имеем в сухом остатке заключение, что не все аудиты одинаково полезны, поэтому в данной статье мы постараемся создать действительно полезный аудит без «воды», которым вы сможете пользоваться как шаблоном для проведения собственных исследований.

Формат аудита

Обычно, если клиент еще не подписал договор на продвижение (находится на стадии выбора подрядчика на SEO), делается так называемый «первичный аудит», который показывает клиенту общее положение дел на сайте. А уже после того, как клиент оценил ваши компетенции, осознал необходимость в ваших услугах и пришел к вам на продвижение, SEO-специалистом делается расширенный аудит, по которому пишутся итоговые рекомендации по доработкам на сайте. После написания рекомендации отправляются клиенту на внедрение (технические доработки, SEO, юзабилити и т.д.).

Примечание: Отличие рекомендаций от аудита состоит в том, что рекомендации являются подробным указанием работ по сайту для достижения целевых результатов, а аудит больше предназначен для общего ознакомления с ситуацией по сайту, как для владельца, так и для SEO-специалиста.

Наш аудит будет состоять из двух файлов: расширенный аудит и рекомендации по доработкам на сайте.

- Помимо того, что аудит делается для клиента как способ показать все негативные моменты на сайте, с другой стороны аудит делается сеошником также для себя самого, чтобы в целом понимать в каком состоянии находится исследуемый сайт. В аудите обычно идут подробные описания недоработок сайта для клиента, чтобы он, не будучи сеошником, понимал, за что отвечает каждый пункт аудита.

- Рекомендации пишутся по аудиту и включают в себя не только пункты расширенного аудита, по которым на сайте существуют проблемы, но также рекомендации включают расширенный анализ сайта с дополнительными пунктами анализа, в том числе и юзабилити-аудитом. По сути рекомендации – это версия аудита, в которой прописано только то, что реально нужно делать для исправления ситуации по сайту с указанием дополнительных работ по улучшению юзабилити сайта.

В данном аудите мы проведем анализ основных технических и SEO-параметров. При необходимости вы сможете дополнить их собственным списком.

Объект аудита

Для примера возьмем некий виртуальный сайт, https://site.ru, у которого не то что все плохо, но уж точно, что есть что подкрутить и улучшить. При проведении анализа будем считать, что средств на использование платных программ и сервисов у нас нет (мы начинающий сеошник или молодое SEO-агентство), поэтому упор будем делать лишь на общедоступные программы и сервисы.

Важно! Как правильно проводить и пользоваться аудитом

1. Использование программ и сервисов для проведения аудита:

- Небольшую часть параметров оптимизатор вполне может проверить вручную (например, наличие и корректность настройки «robots.txt» и «sitemap.xml», наличие «хлебных крошек»).

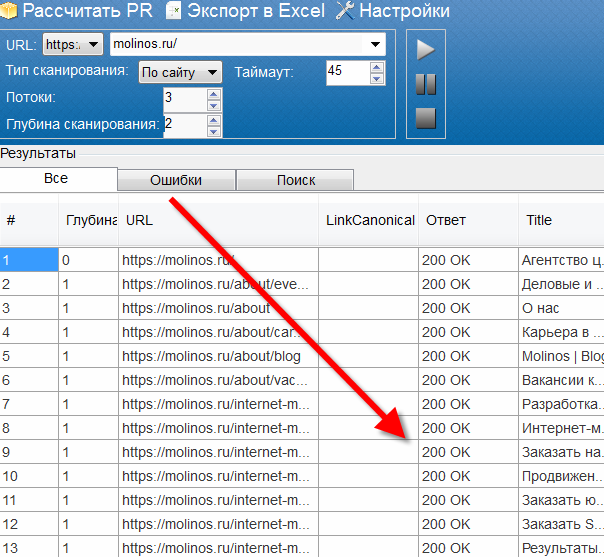

- Мета-теги, битые ссылки, дубликаты страниц и т.п. технические вещи удобно проверять при помощи специальных программ для технического аудита сайта – я рекомендую использовать наш бесплатный SiteAnalyzer.

- Остальные сервисы, используемые для анализа тех или иных параметров сайта, по возможности указаны персонально для каждого пункта аудита (ссылки на все используемые ресурсы см. в конце статьи).

2. Практически у каждого пункта аудита есть список либо абзацы, выделенные звездочками (*). Это так называемые «пункты на выбор» – проходя по каждому разделу аудита, оптимизатор после анализа пункта оставляет наиболее подходящий элемент списка (или абзац со звездочкой), а остальное удаляет. Таким образом, после прохождения всех пунктов остаются только актуальные комментарии для данного аудита (все лишнее просто-напросто удаляем).

3. Скриншоты добавляются по необходимости. Для каждого пункта они, наверное, не обязательны, но желательно протоколировать особенно показательные ошибки на сайте (чтобы, как минимум, сохранились доказательства имеющихся ошибок).

Шаблон аудита

План аудита

- Показатели сайта

- Проверка файла robots.txt

- Проверка наличия Sitemap.xml

- Сквозная ссылка на главную страницу в логотипе / шапке сайта

- Проверка скорости загрузки сайта

- Проверка наличия частичных и полных копий сайта (дубликаты)

- Проверка настройки ЧПУ

- Проверка корректности верстки и HTML-кода на наличие ошибок

- Проверка корректности заголовков 1 уровня (<H1>)

- Проверка использования тегов заголовков в элементах дизайна

- Проверка сайта на битые ссылки

- Обработка ошибки 404

- Внешние ссылки

- Оценка наполнения сайта

- Проверка на дублирование заголовков и мета-тегов

- Проверка наличия компании в Яндекс.Справочнике и Google Мой бизнес

- Навигация «хлебные крошки» (обратный путь по сайту)

- Наличие атрибутов изображений на сайте

- Наличие мобильной версии сайта

- Файл favicon.ico

- Сессии

- Микроразметка

- Относительные ссылки

Технический аудит сайта «site.ru»

1. Показатели сайта

- ИКС: 10

- Страниц в индексе Яндекса: 206

- Страниц в индексе Google: 2250

- Дата регистрации домена: 04.06.2009

Проверяем по RDSBar — recipdonor.com/bar

Комментарии к разделу (актуальное для данного раздела оставляем, остальное удаляем из аудита):

- Большая разница числа страниц в индексе Яндекса и Google свидетельствует о наличии проблем с индексацией.

- * Молодому сайту (возраст менее полугода) потребуется больше усилий для попадания в ТОП, нежели возрастному сайту, имеющему историю и доверие поисковых систем.

- * Главное меню сайта не должно быть реализовано на javascript, flash и прочих скриптах, чтобы поисковые роботы свободно ходили по сайту и учитывали все нужные страницы сайта.

- * Одностраничный «лэндинг» по конкурентным запросам продвинуть сложнее, чем полноценный сайт.

2. Проверка файла robots.txt

Файл «robots.txt» присутствует, однако настроен некорректно. Рекомендуется закрыть от индексации служебные разделы и разрешить Google и Яндекс индексировать .js и .css файлы, а также прописать ссылку на «sitemap.xml».

Текущее содержимое «robots.txt»:

Вставляем текущее содержимое robots.txt…

3. Проверка наличия Sitemap.xml

В настоящее время файл «sitemap.xml» отсутствует – НЕКОРРЕКТНО

* Файл «sitemap.xml» присутствует, однако данные, размещенные в нем, указаны не полностью:

- отсутствует параметр «lastmod»

- отсутствует параметр «priority»

- отсутствует параметр «changefreq»

* Необходимо сформировать новый файл «sitemap.xml» с корректными данными и разместить его в корне сайта.

4. Сквозная ссылка на главную страницу в логотипе или шапке сайта

Присутствует, однако у логотипа в шапке сайта не прописан тег «alt», что противоречит пожеланиям поисковых систем по оформлению сайтов. Необходимо в данном теге прописать название и краткое описание сайта.

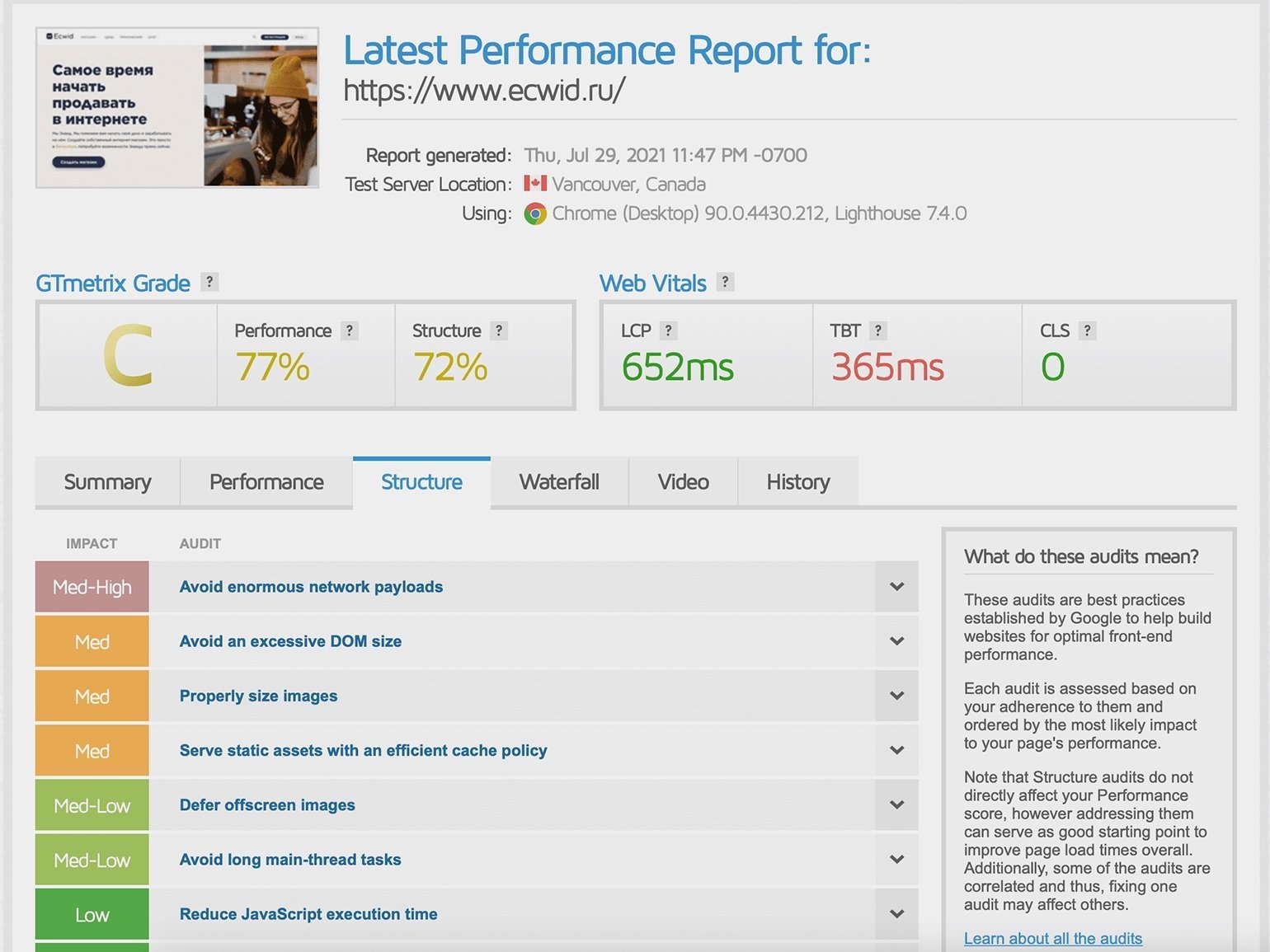

5. Проверка скорости загрузки сайта

Скорость загрузки сайта оценена как «средняя». Сейчас она составляет ~4,9 секунд. Более подробная информация по очередности и времени загрузки всех элементов по отдельности на скриншоте ниже:

Скорость проверяем сервисами gtmetrix.com или webpagetest.org

- Рекомендуется задействовать функцию кеширования браузером статичных элементов сайта для ускорения его загрузки.

- Необходимо настроить отдачу 304 заголовков (отдача страницы из кеша), которые бы позволили не загружать повторно уже загруженные элементы сайта, если те не изменялись.

- Рекомендуется минимизировать редиректы, возникающие из-за некорректных внешних ссылок на библиотеки яваскриптов.

- Рекомендуется оптимизировать изображения для сокращения их объема, что приведет к ускорению загрузки сайта и сэкономит трафик пользователей.

- По возможности использовать компрессию GZip для сжатия передаваемых данных и, соответственно, уменьшения скорости их загрузки.

- Для ускорения загрузки контента сайта рекомендуется перенести подключение файлов .js в низ страницы и расположить их под html-кодом основного контента (перед закрывающим тегом </body>).

- Рекомендуется оптимизировать загрузку множества мелких изображений путем размещения их в одном файле и поспрайтовой подгрузки в нужную область при помощи CSS.

- Подробная информация по всем доработкам https://gtmetrix.com/reports/site-analyzer.ru/WjELD5yT

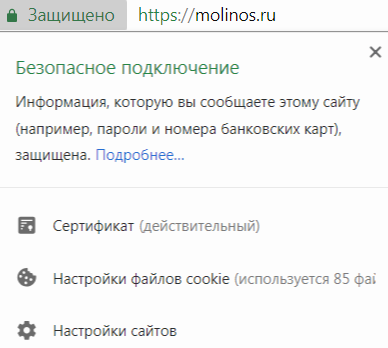

6. Проверка наличия частичных и полных копий сайта (дубликаты)

- С версии сайта с WWW выполняется редирект на основной сайт без него «site.ru» – КОРРЕКТНО

- * На данный момент для индексации доступны страницы как с WWW, так и без него – НЕКОРРЕКТНО. Поисковые системы считают такие страницы разными, поэтому необходимо сделать 301 редирект со страниц с WWW на страницы без него, т.к. основное зеркало определено без WWW.

- Сайт доступен только по одному из протоколов: HTTP / HTTPS – КОРРЕКТНО

- * Сайт доступен по обоим протоколам, что создает дубли страниц и тем самым затрудняет продвижение сайта в поисковых системах — НЕКОРРЕКТНО

- * Найдены дубли страниц со слешем «/» и без «/» на конце – НЕКОРРЕКТНО. Рекомендуется выполнить настройку 301 редиректа со страниц без слеша «/» на конце, на страницы со слешем.

- Для дублей страниц, создаваемых использованием параметров в URL, если таковые имеются, прописан тег rel=»canonical» – КОРРЕКТНО

- Используются атрибуты rel=»next» и rel=»prev» для обозначения страниц пагинации – КОРРЕКТНО

- По контактному телефону или рег. информации (ИНН, ОГРН) находится только один сайт (кроме справочных сайтов) – КОРРЕКТНО

7. Проверка настройки ЧПУ

ЧПУ (человеко-понятные URL) настроены – КОРРЕКТНО

ЧПУ лучше воспринимаются поисковыми роботами, а также поисковые роботы учитывают адрес, как один из факторов улучшения ранжирования.

8. Проверка корректности верстки и HTML-кода на наличие ошибок

Согласно валидатору W3C (https://validator.w3.org/) в коде найдено 43 ошибки. Из них есть критичные, которые необходимо исправить в первую очередь:

-

отсутствие указаний размеров к изображениям

-

отсутствие тегов «alt» для изображений

-

дублирование атрибута ID, что не корректно

-

отсутствие атрибута «type» для скриптов

-

необходимо вынести все стили и скрипты из HTML в отдельные файлы, чтобы очистить верстку от лишнего кода (примеры см. ниже):

Вставляем скриншоты с наиболее популярными ошибками

На сайте не должно быть критических ошибок верстки (в идеале – ошибок не должно быть вообще).

9. Проверка корректности заголовков 1 уровня (H1)

- В результате аудита были выявлены страницы, не имеющие заголовка H1 (в том числе и главная страница), что некорректно и может отрицательно сказаться на ранжировании сайта.

- * В результате аудита было выявлено несколько страниц, имеющих более одного заголовка H1, что некорректно и может отрицательно сказаться на ранжировании сайта.

Заголовок H1 должен обязательно присутствовать на каждой странице сайта и быть по возможности кратким, отражать суть страницы, содержать самый важный запрос и быть единственным на странице.

Примеры страниц с некорректным H1:

Вставляем скриншоты с некорректным H1

10. Проверка использования тегов заголовков в элементах дизайна

Тег H3 дублируется в верхних блоках с преимуществами компании. Для выделения подобных шаблонных заголовков блоков рекомендуется использовать теги DIV и SPAN, так как теги H1-H6 больше предназначены для использования в текстовом контенте.

Вставляем скриншоты с некорректным H1-H6

Не рекомендуется использовать теги заголовков для названия формы обратной связи или предваряющего сообщения. Иначе структура контента страницы будет нарушена, что является недочетом согласно рекомендациям поисковых систем.

11. Проверка сайта на битые ссылки

На сайте обнаружены «битые» ссылки на странице site.ru/kak-eto-rabotaet (см. скриншот ниже):

Вставляем скриншоты с битыми ссылками №1

А также, на странице http://site.ru/pokazaniya/pohudenie (см. скриншот ниже):

Вставляем скриншоты с битыми ссылками №2 и т.п.

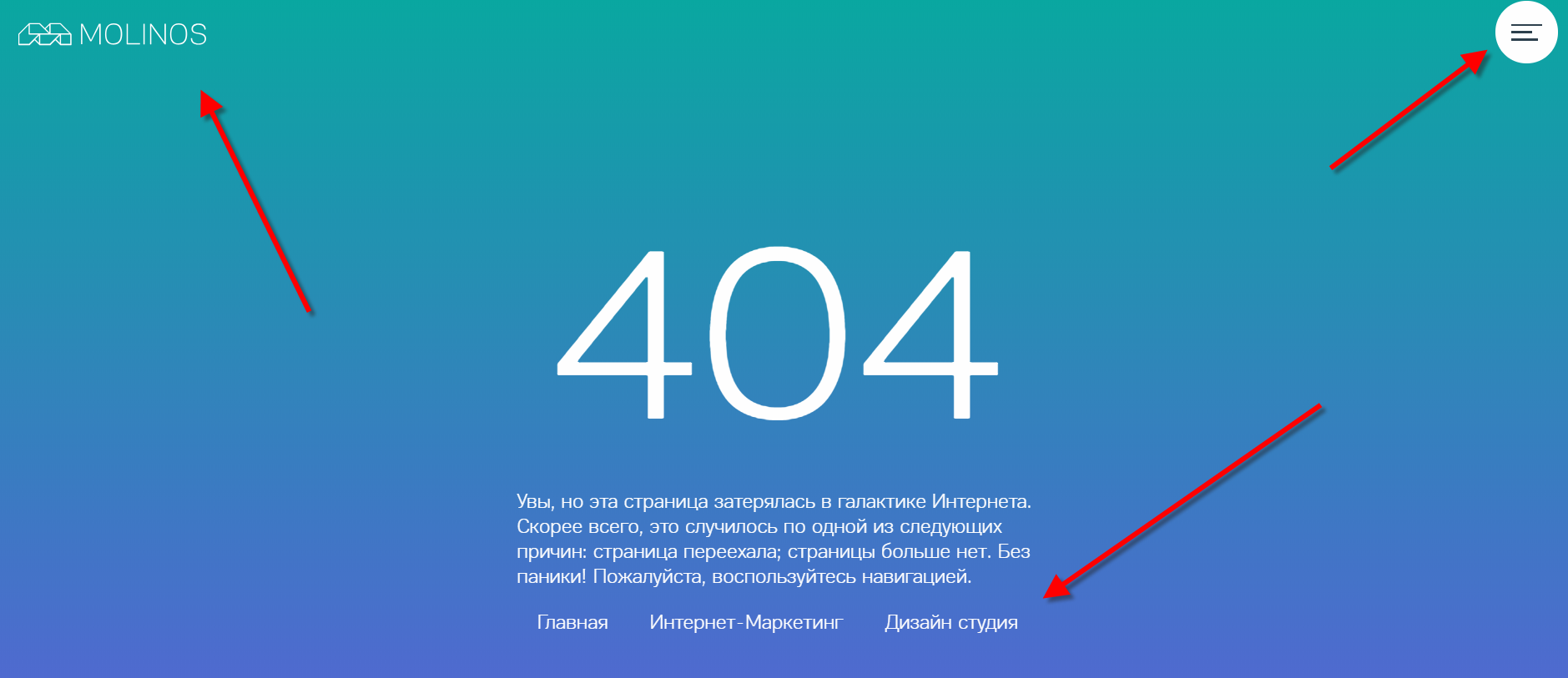

12. Обработка ошибки 404

Обработчик страницы 404 (не найдена) присутствует – КОРРЕКТНО

Однако не для всех типов несуществующих страниц настроен обработчик страницы 404 (не найдена).

Примеры URL:

- https://www.site.ru/uslovija-sotrudnich (отдается код 200 вместо 404)

- https://www.site.ru/uslovija-sotrudnichestva/ (отдается код 404, но страница не оформлена в соответствии с дизайном сайта)

- https://www.site.ru/shop/brjuki (отображается, что страница не найдена, но по факту отдается код 200 вместо 404)

* На данный момент при вводе некорректного URL пользователю отображается стандартное сообщение сервера о том, что указанной страницы не существует.

* Необходимо настроить сервер таким образом, чтобы при вводе некорректного URL сайт отдавал пользователю 404 страницу, оформленную в стиле сайта и информирующую его о некорректно набранном URL, а также отображающую возможные пути дальнейшей навигации по сайту (например, ссылка на основные его разделы).

Пример:

К сожалению, запрашиваемой вами страницы не существует, либо она была удалена.

Однако, вы можете посетить следующие разделы сайта:

• Главная

• О компании

• Модельный ряд

• Услуги

• Автосервис

• Новости

• Контакты

* Сейчас сайт отдает для несуществующих страниц ответ 200 (вместо 404 ошибки). В данном случае поисковый робот, заходя по адресу несуществующей страницы, индексирует ее. Необходимо настроить корректную обработку несуществующих страниц.

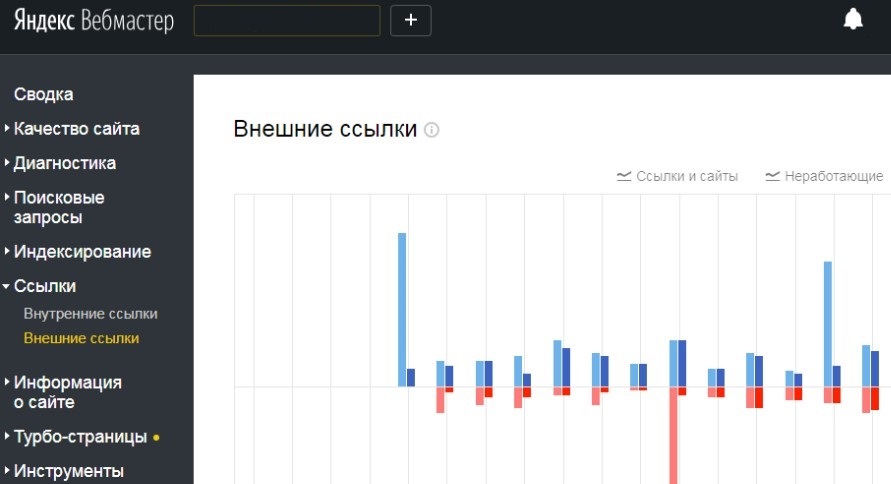

13. Внешние ссылки

Ссылки на внешние ресурсы: 33.

Наличие внешних ссылок способствует передаче веса, накопленного сайтом на другие ресурсы, что недопустимо для его корректного продвижения.

Рекомендуется свести это значение к минимуму и по возможности убрать все внешние ссылки на ресурсы схожей тематики (кроме очень качественных и трастовых) либо закрыть их в мета-теги и rel=»nofollow», а также добавить атрибут «target=»_blank».

14. Оценка наполнения сайта

На сайте присутствуют страницы без контента. Пример такой страницы: https://site.ru/testirovanie-daignoza (см. скриншот ниже):

Вставляем скриншоты страниц без контента

Подобные «пустые» страницы повышают процент отказов и ухудшают пользовательские факторы сайта, что влечет за собой ухудшение видимости сайта в выдаче поисковых систем, поэтому необходимо их наполнить контентом, либо скрыть от пользователя до того момента, как страницы будут готовы и наполнены информацией.

* Контент сайта в целом находится на приемлемом уровне.

Более детальный отчет по доработкам контента будет представлен при непосредственной работе по продвижению сайта.

15. Проверка на дублирование заголовков и мета-тегов

TITLE (заголовок страниц браузера)

Большинство страниц содержат не достаточно информативный мета-тег «title», который мало способствует продвижению как отдельных страниц, так и всего сайта в целом.

* Большинство страниц содержат пустой мета-тег «title».

Необходимо для каждой страницы сайта составить уникальный тайтл длиной 10-15 слов с включением ключевых фраз, наиболее релевантных содержимому данной страницы.

Description (мета-описание страниц)

Заполнение мета-тега «description» на сайте не предусмотрено.

* Большинство страниц сайта содержат пустой мета-тег «description».

* Неправильно составленные мета-теги: содержат мало информации и ключевых слов, либо переспам (отсутствие законченной фразы, перечисление ключевых фраз, короткий текст).

Необходимо добавить в систему управления сайтом возможность заполнения данного мета-тега произвольным текстом.

* Необходимо для каждой страницы прописать свой уникальный мета-тег «description», отражающий содержание страницы и содержащий дополнительную осмысленную полезную/рекламную информацию.

H2-H6 (подзаголовок)

На странице https://site.ru/video присутствуют одинаковые заголовки H2, что негативно влияет на ранжирование сайта, т.к. говорит о некачественном контенте (поскольку поисковики не видят, что именно изображено на видео, они решают, что, поскольку фреймы с видео находятся под одинаковыми заголовками, с высокой вероятностью данный контент – просто дублирующийся).

* Тег H2 присутствует в заголовках блоков новостей, вследствие чего дублируется на разных страницах сайта. Это некорректно и должно быть исправлено, подробнее см. п.10.

16. Проверка наличия компании в Яндекс.Справочнике и Google Мой бизнес

Смотрим yandex.ru/sprav/companies + business.google.com/add?service=plus&hl=ru

- Компания присутствует в Яндекс.Справочнике – КОРРЕКТНО

- Компания присутствует в сервисе Google Мой бизнес – КОРРЕКТНО

* К сожалению, Ваша компания не найдена ни в Яндекс.Справочнике ни в сервисе Google Мой бизнес, что может привести к потере части потенциальных посетителей.

17. Навигация «хлебные крошки» (обратный путь по сайту)

Присутствует – КОРРЕКТНО

* Для более качественной проработки юзабилити, а также для более четкого представления пользователя, где он находится в данный момент на сайте, рекомендуется добавлять навигацию типа «Хлебные крошки». Все элементы «пути» крошек, кроме последнего, являются ссылками, по которым пользователь может переходить на разделы более высокого уровня. «Путь» должен начинаться с главной страницы и заканчиваться указанием текущего раздела.

18. Наличие атрибутов изображений на сайте

Атрибуты «alt» присутствуют – КОРРЕКТНО

* К сожалению, у изображений на сайте нет уникальных атрибутов «alt», что лишает ресурс части потенциальных покупателей из сервисов Яндекс и Google Картинки, а также снижает контентную релевантность сайта.

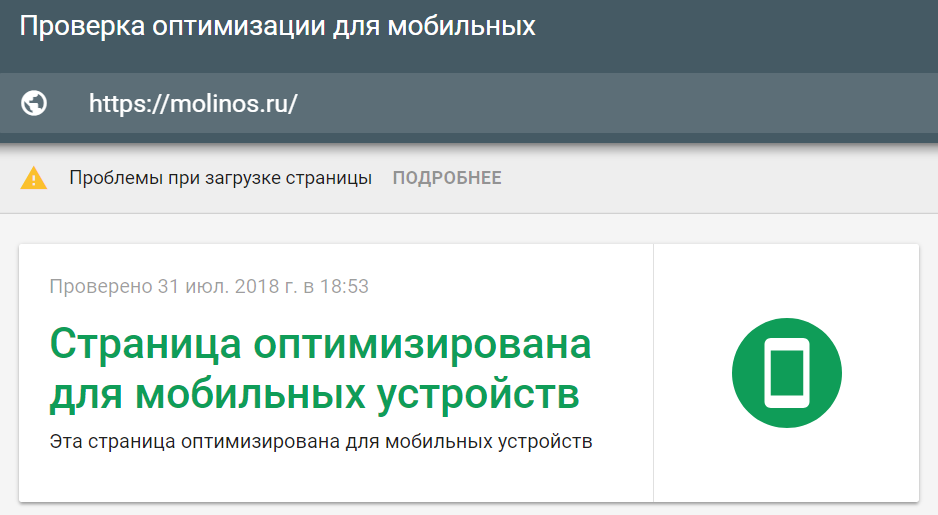

19. Наличие мобильной версии сайта

Мобильная версия сайта присутствует – КОРРЕКТНО

* К сожалению, сайт не имеет мобильной (адаптивной) версии, что может отрицательно сказаться на его позициях в мобильной выдаче и на его ранжировании в целом.

20. Файл favicon.ico

Иконка сайта отсутствует – НЕ КОРРЕКТНО

Наличие иконки сайта дает возможность обратить на себя большее внимание сайту в поисковой выдаче и тем самым привлечь больше посетителей.

Необходимо переписать в корень сайта приложенный файл «favicon.ico» и добавить в секцию HEAD сайта строку:

<link href=»/favicon.ico» rel=»shortcut icon»>

21. Сессии

Сессии в адресе страниц отсутствуют – КОРРЕКТНО

* Сайт не должен использовать сессии в адресе страниц. Это вызвано тем, что при каждом заходе поискового робота на сайт ему присваивается идентификатор сессии (параметр PHPSESSID в URL страницы) и каждая страница имеет URL, отличный от URL, сформированного при другом значении сессии, что крайне негативно отражается на индексации сайта.

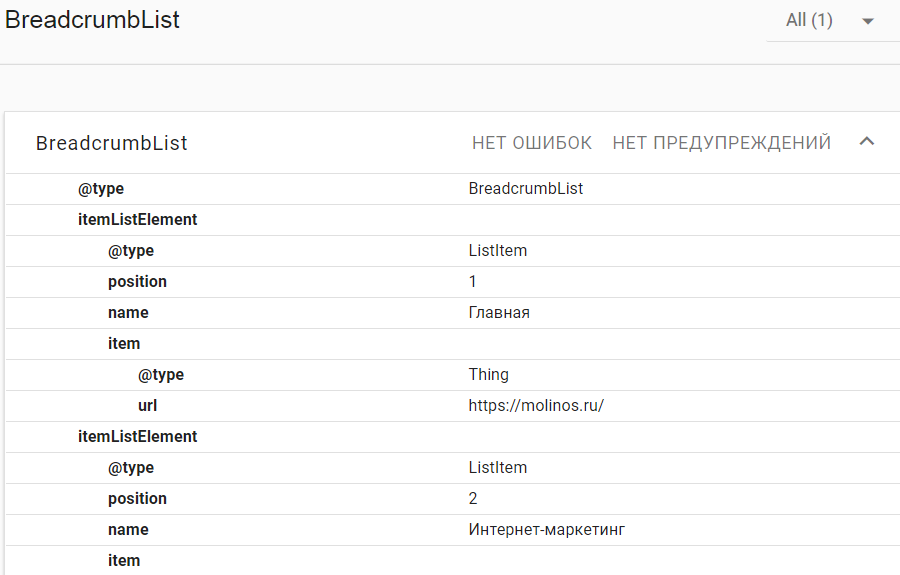

22. Микроразметка

Смотрим webmaster.yandex.ru/tools/microtest/

Микроразметка на сайте присутствует – КОРРЕКТНО

* Необходимо внедрить микроразметку на страницу с контактами / товарами / статьями. Это даст возможность поисковым системам яснее понимать содержание контента страниц, а также поможет выделить сайт в выдаче поисковых систем более привлекательно.

23. Относительные ссылки

Проблем не обнаружено – КОРРЕКТНО

* При использовании внутренних ссылок необходимо, чтобы URL относительных ссылок начинался со слеша, т.е. как пример, вместо [a href=»https://site.ru/company/about/»], нужно использовать [a href=»/company/about/»], иначе возможны проблемы с некорректной индексацией сайта.

Проверка ошибок по Яндекс Метрике и Вебмастеру

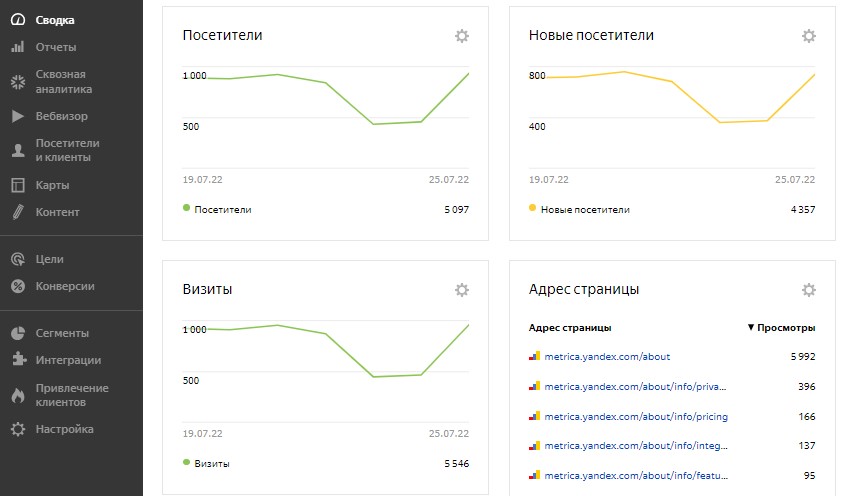

Проверка динамики показателей счётчика Яндекс.Метрика

- Динамика посещаемости на сайте стандартная для сайтов данной тематики – КОРРЕКТНО

- Динамика конверсии на сайте стандартная для сайтов данной тематики – КОРРЕКТНО

Очевидных проблем не выявлено, однако, хочется заметить, что на сайте всего одна однозначно конверсионная цель: «Заказ товаров», что не позволяет в полной мере оценить конверсионность сайта, т.к. с текущей настройкой целей конверсия сайта составляет ~0,5%.

Для данного типа интернет-магазинов рекомендуется настроить больше путей совершения целевого действия пользователем и контактов с ним.

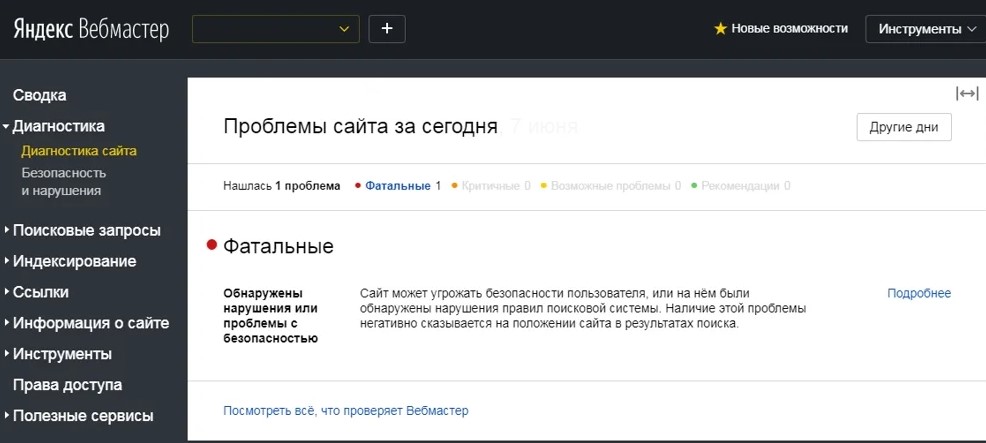

Проверка ошибок сайта в панели Вебмастер

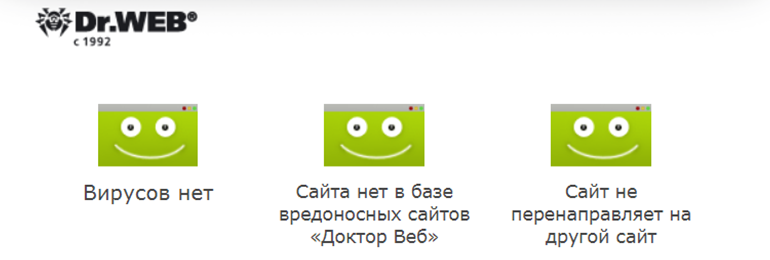

Безопасность и нарушения

- Писем с нарушениями и угрозами безопасности на сайте не обнаружено – КОРРЕКТНО

Исключенные страницы

-

На данный момент, присутствует порядка 20 страниц, отдающих ошибку при переходе на них (ошибка 404, страница не найдена). Отчет об этих страницах можно посмотреть по ссылке: https://webmaster.yandex.ru/site/ваш_хост:80/indexing/indexing/?page=&samplesType=event&filters=%7B%7D (выбрать в колонке «Стало» фильтр «HTTP-код 404»).

-

Пример такой страницы: https://site.ru/shop/krossovki/na-lipuchke

Вставляем скриншоты из Яндекс Вебмастера

Подобные ошибки на сайте, отображающие исходный код, дают слишком много информации о структуре сайта и его баз данных, что может быть использовано потенциальными злоумышленниками для причинения вреда ресурсу (взлом, подмена содержимого, кража ресурса, денежных средств, при наличии доступа, и т.п.).

Внешняя оптимизация

Количество ссылок, ведущих на сайт: 2592 (если есть доступ в Яндекс Вебмастер).

* Количество ссылок, ведущих на сайт: порядка 148 с 26 доменов.

Сайты-доноры в большинстве своей массы являются каталогами сайтов и бесплатными досками объявлений, по большей части не пересекающимися с тематикой «ВашаТематика».

Рекомендуется по возможности отказаться от некачественной ссылочной массы и наращивать объем ссылочной массы с ресурсов с большим числом посещений и близких по тематике к данному сайту.

* Как видно из графиков, сайт практически не имеет внешней ссылочной массы, что, конечно же, не способствует росту доверия к сайту в глазах поисковых систем и, соответственно, не ведет к росту его позиций.

* Анкоры (тексты ссылок) в массе своей содержат URL сайта. Необходимо разбавить анкорную базу вхождениями продвигаемых ключевых фраз.

* Данное количество недостаточно для продвижения в такой конкурентной тематике, как «ВашаТематика». Анкоры (тексты ссылок) в массе своей содержат неразбавленные ключевые слова, что не соответствует современным методам продвижения.

* Рекомендуется наращивать объем ссылочной массы с ресурсов с большим числом посещений и близких по тематике к данному сайту.

* Рекомендуется наращивать объем ссылочной массы с ресурсов с большим числом посещений и близких по тематике к данному сайту, а также увеличивать число ссылающихся уникальных сайтов для повышения ссылочного охвата.

Рекомендуемые работы по сайту

Данная выжимка по аудиту идет в самом конце и позволяет клиенту оперативно оценить состояние сайта без необходимости подробного изучения всего документа.

На основе проведенного аудита нами рекомендуется провести следующий список работ по сайту:

- Исправление проблем с некорректной настройкой «robots.txt» (разрешить индексацию изображений, закрыть от индексации служебные разделы).

- Исправление неактуального содержимого «sitemap.xml» (корректная настройка «sitemap.xml» позволяет поисковым роботам быстрее индексировать новый контент).

- Ускорение времени загрузки сайта (сейчас оно занимает более 5 секунд), которую нужно оптимизировать желательно до 3-х секунд (низкая скорость загрузки сайта является весомым фактором для поисковых систем и отрицательно влияет на его ранжирование).

- Настройка обработчика для страниц «404 (не найдена)» и возврат кода 404 для несуществующих страниц.

- Настройка главного зеркала и устранение дублей страниц с WWW и без него.

- Настройка ЧПУ для всех страниц сайта (ЧПУ лучше воспринимаются поисковыми роботами, а также поисковые роботы учитывают адрес, как один из факторов улучшения ранжирования).

- Исправление ошибок верстки в HTML-коде страниц (их наличие негативно воспринимаются поисковыми системами).

- Наполнение содержимого тегов «alt» и «title» для изображений (их отсутствие снижает видимость сайта в сервисах Яндекс и Google Картинки, а также понижает его контентную релевантность).

- Добавление в код страниц тега «h1» там, где они отсутствуют (его наличие является важным фактором, а отсутствие влечет понижение в ранжировании).

- Заполнение и уникализация мета-тегов «title», «description» и «h1» для избавления от дублей (все это может затруднить продвижение сайта и негативно сказаться на его позициях).

- * Оптимизация мета-тегов «title», «description» и «h1» для лучшего ранжирования.

- Избавление от «битых» ссылок в навигации сайта (большое число «битых» ссылок отрицательно влияет на пользовательские факторы сайта и на его ранжирование).

- Наполнение информацией страниц с отсутствующим контентом («пустые» страницы повышают процент отказов и ухудшают пользовательские факторы сайта, что влечет за собой ухудшение видимости сайта в выдаче).

- Избавление от избыточных ссылок на внешние ресурсы.

- Наращивание качественной ссылочной массы с внешних ресурсов.

Таким образом, ускорив загрузку сайта и убрав прочие технические недочеты, сайт станет более качественным и готовым к приему клиентов.

Заключение

Написание рекомендаций в контексте данной статьи рассматривать мы не будем, так как они не сильно отличаются от аудита + приложены в виде файла к данному материалу.

Надеюсь, что данный аудит поможет начинающим сеошникам, а также оптимизаторам без опыта работы в рекламных агентствах в проведении качественных аудитов для своих клиентов!

Отдельно хочу заметить, что при проведении аудитов ручной анализ всех исследуемых параметров не целесообразен и должен занимать как можно меньшую его часть – сбор основных параметров и ошибок на сайте оптимальней доверить системам автоматизированного анализа сайта, таким как, например, программа SiteAnalyzer, автором которой я непосредственно являюсь. А уже исходя из результатов автоматизированного аудита будет намного проще составить документ с рекомендациями по найденным ошибкам и недочетам на сайте.

Благодарю за внимание!

P.S. При заказе аудита на стороне или проведения его собственными силами важно понимать, что сам по себе аудит без внедрения будет совершенно бесполезен — он не продвинет сайт, не увеличит ваш трафик и не принесет лидов. Только максимальное внедрение аудита и следование его рекомендациям сможет помочь достигнуть лучших позиций вашему сайту. Имейте это в виду при планировании бюджетов на продвижение вашего бизнеса.

Прилагаемые файлы

- Шаблон_Аудит.docx

- Шаблон_Рекомендации.docx

- Шаблон_Рекомендации_Оптимизация_страниц.docx

Используемые программы и сервисы:

- SiteAnalyzer (бесплатный веб-краулер для комплексного аудита сайта)

- RDSBar / NIC.ru (проверка основных параметров сайта + возраст сайта)

- Ahrefs / Megaindex (проверка внешних ссылок на сайт)

- Яндекс Метрика (система статистики посещений сайта Яндекс)

- Яндекс Вебмастер / Google Вебмастер (панель вебмастера Яндекс и Google)

- Яндекс.Справочник / Google Мой бизнес (справочники Яндекс и Google)

- W3C Markup Validation Service (валидация HTML-кода)

- GTMetrix / WebPageTest (анализ скорости загрузки сайта)

#Руководства

-

0

Отвечаем на главные вопросы: что, зачем и как часто нужно отслеживать. Бонусы: чек-лист и список программ для самостоятельного SEO-аудита.

Абрикос Абрикосовый для Skillbox Media

Старший редактор по маркетингу, управлению и бизнесу в Skillbox Media. Десять лет назад настроил «Директ», и всё завертелось…

краткая справка

Занимается продвижением сайтов с 2007 года. Руководитель агентства интернет-маркетинга Impulse.guru, спикер «Деловой среды», «Синергии», «Нетологии». Входит в топ-10 фронтменов и спикеров по SEO по версии компании «Ашманов и партнёры».

Сайт: Impulse.guru

- Какие задачи решает SEO-аудит и как часто его нужно проводить

- Что анализировать: основные направления аудита

- В каких случаях анализ стоит делегировать специалисту, а когда его можно сделать самому

- Восемь сервисов для проверки сайта по SEO-параметрам

- Чек-лист для самостоятельного SEO-аудита: 23 вещи, которые надо проверить

- Что ещё почитать в Skillbox Media о SEO

SEO-аудит — это проверка сайта на соответствие требованиям поисковых систем. Он должен устранить препятствия, которые мешают ресурсу продвигаться в поиске, и показать направления для дальнейшего роста его популярности.

После анализа у вас на руках будут списки ошибок и задач. Разобравшись с ними, вы улучшите позиции сайта в «Яндексе» и Google.

Любой сайт, если он развивается, будет меняться. Поэтому SEO-аудит нужно проводить регулярно. Это проверка здоровья ресурса и профилактика возможных проблем. Она особенно нужна коммерческим проектам, ведь для них сайт — важный источник клиентов и продаж.

Частота аудита зависит от характеристик проекта. Усреднённая рекомендация будет звучать так: проводите его хотя бы дважды в течение года.

Регулярный SEO-аудит позволяет:

- Найти слабые места сайта и точки роста. Это нужно, чтобы правильно распределить доступные ресурсы (время и бюджет) и получить от них максимальную отдачу. Иногда даже небольшие изменения на сайте могут привести к хорошим и довольно быстрым результатам.

- Разобраться в проблемах с индексацией. Чаще проблемы относятся к одной из двух групп: не все нужные страницы попадают в индекс поисковиков, или, наоборот, индексируется нежелательный контент. Например, продублированные или автоматически сгенерированные движком сайта служебные страницы.

- Отреагировать на изменения в алгоритмах. Google и «Яндекс» меняют алгоритмы ранжирования, стараясь улучшить поисковую выдачу. Чтобы удерживать позиции и сохранять трафик, нужно следить за этими изменениями и менять сайт под новые требования поисковиков. Например, использовать HTTPS или повысить скорость загрузки сайта — об этом часто говорят представители поисковых систем.

- Найти и исправить ошибки на сайте. Если ресурс «живой» — ошибки неизбежны. Даже простое обновление движка или одного из используемых плагинов может привести к ним. Программисты, работающие над сайтом, тоже не всегда соблюдают требования SEO. Пример: на веб-ресурсе случайно поменялись URL-адреса важных страниц. Это привело к ухудшению их позиций в выдаче, теперь для них нужно настроить переадресацию. Такую ошибку можно найти и исправить в результате SEO-аудита.

Комплексный SEO-аудит состоит из пяти больших частей. Разберём каждую из них.

- Технический SEO-аудит. Суть понятна из названия. Это анализ всех технических аспектов сайта, которые влияют на его позиции в поиске, — например, карты сайта, robots.txt, корректности метатегов Title и Description, наличия дублей страниц, скорости загрузки.

- Аудит юзабилити. Чем удобнее сайт для пользователей, тем лучше поведенческие факторы. Они влияют не только на конверсию, но и на позиции сайта в поиске. Значимость поведенческих факторов выше для тех ресурсов, которые борются за топовые позиции в «Яндексе».

Во время анализа юзабилити нужно изучить навигацию, структуру, элементы, с которыми взаимодействует пользователь, отображение на мобильных устройствах и другие подобные вещи.

- Аудит внешних факторов. В первую очередь это обратные ссылки на сайт. Кроме того, в эту группу входят факторы, важные для локального SEO-продвижения (например, присутствие в «Яндекс.Справочнике», в «Яндекс.Картах», в «Google Мой бизнес»).

- Аудит контента. Качественный уникальный контент всегда был основой поисковой оптимизации. Нужно проанализировать уровень его оптимизации, структуру, оформление, соответствие семантическому ядру. Анализ контента позволяет понять, стоит ли увеличивать его объём и как это лучше сделать.

- Аудит коммерческих факторов ранжирования. Это отдельная группа характеристик, актуальных для тех, кто что-либо продаёт через сайт. В неё входят ассортимент товаров, их описания, контактная информация, онлайн-консультант, наличие доставки. Эти характеристики учитываются при формировании выдачи по коммерческим запросам — например, «купить товар X».

Их нужно анализировать при продвижении в «Яндексе»: представители поисковика заявляли, что отдельно выделяют коммерческие факторы. От Google такой информации не было.

При полном SEO-аудите подход должен быть комплексным. Ни одно из перечисленных направлений анализа нельзя игнорировать. Тем не менее некоторые из типов аудита стоит выполнять регулярно, а другие можно закрыть разовой проектной работой. Всё зависит от конкретного проекта.

Если сайт только готовится к запуску, достаточно технического аудита. Данных аналитики ещё нет, и аудит юзабилити невозможен. Для большинства лендингов и интернет-магазинов не нужен аудит контента: у них нет раздела с информационными статьями. Аудит юзабилити нужно провести, если требуется получить максимум от уже имеющегося трафика, чтобы точечно проработать посадочные, оптимизировать конверсию.

Комплексный аудит проводят, если SEO-специалисты ещё не работали с сайтом. Нужно понять состояние веб-ресурса. Полная проверка также требуется сайтам с неудовлетворительными результатами продвижения — чтобы понять, что мешает подниматься в поиске.

Если владелец сайта понимает основные механизмы поисковой оптимизации, то он может провести базовый SEO-аудит самостоятельно. Специалисту по интернет-маркетингу будет ещё легче справиться с этой задачей (в следующем разделе мы разберём инструменты, которые помогут в этом).

Но если нужно проанализировать сайт с большим объёмом контента, то стоит привлечь профильных специалистов. Другой пример сложного кейса, где нужны эксперты: есть подозрения, что сайт подпал под санкции поисковых систем.

Если в штате компании нет специалиста по SEO, у вас два варианта: найти исполнителя на фрилансе или обратиться в агентство. Первый вариант более рискованный, второй обычно намного дороже. Я бы рекомендовал сотрудничать с агентством. К фрилансеру стоит обращаться, если есть хорошие рекомендации от знакомых, которые раньше с ним работали.

Важно: для эффективного аудита нужны доступы к сайту, веб-аналитике и панелям вебмастеров. Передавать такие данные стоит только тем людям, в которых вы уверены.

На рынке есть десятки платных и бесплатных инструментов для SEO-аудита, которые помогают проанализировать сайт по разным параметрам. Расскажу про восемь сервисов, которые охватывают весь спектр задач SEO-аудита.

В Skillbox Media опубликована расширенная подборка инструментов для самостоятельного SEO-аудита: от бесплатных программ до мощных SaaS-платформ. В ней девять инструментов, отсортированных по цене.

Читать подборку

1. Istio

Бесплатный сервис для проверки текстов по SEO-параметрам. Анализирует их длину, количество слов, тошноту, плотность ключевиков и другие полезные мелочи. В расширенной версии доступны карта слов, выделение ключевиков и анализ текста на странице по ссылке.

2. MegaIndex

Многофункциональная платформа. Внутри более 30 приложений, заточенных под конкретные задачи. Для комплексного SEO-аудита здесь есть если не всё, то почти всё.

Рекомендую обратить внимание на модуль для анализа обратных ссылок. Качество его работы — на уровне Ahrefs, но платный месячный тариф в два раза дешевле.

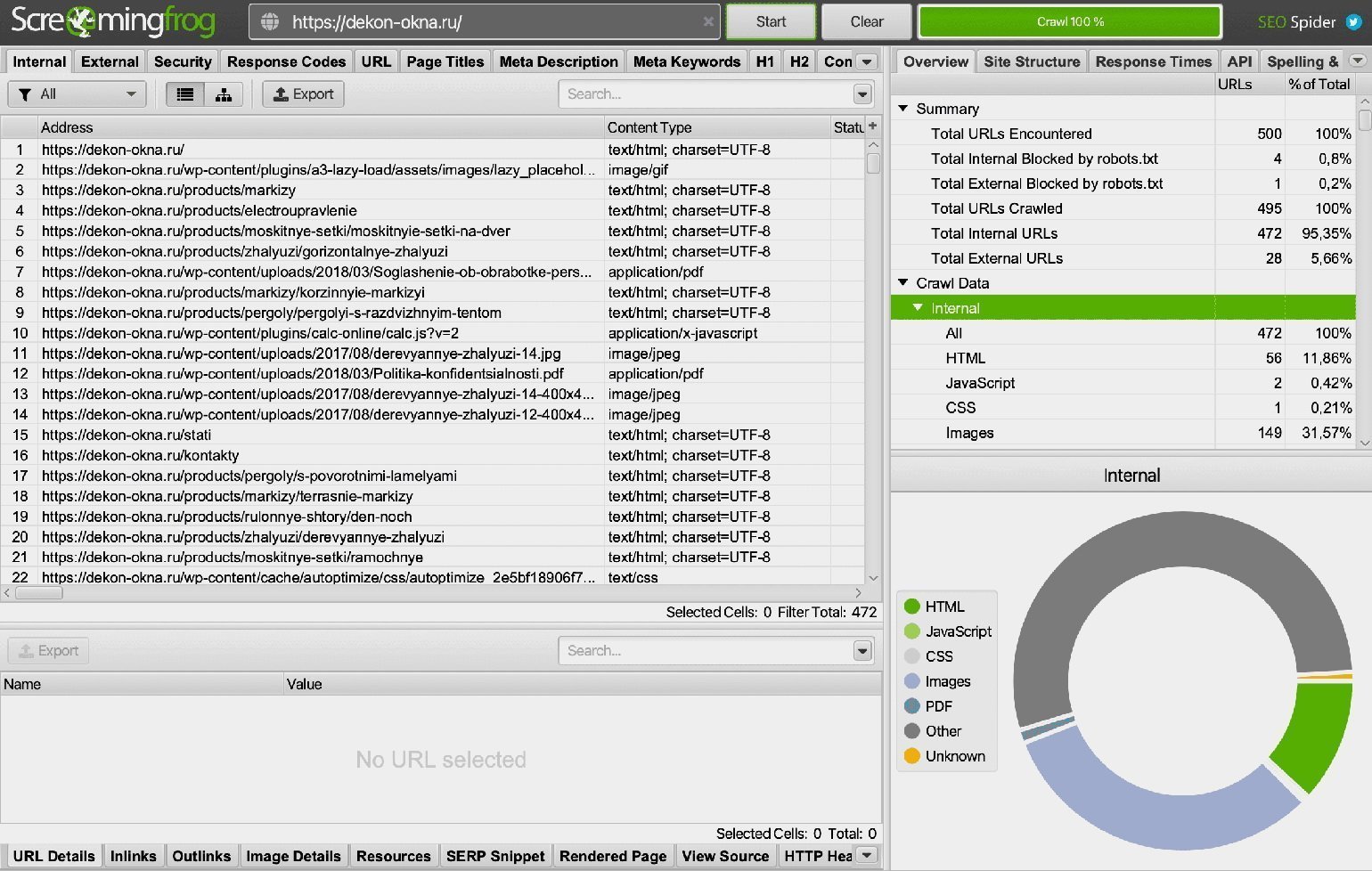

3. Screaming Frog SEO Spider

Пожалуй, лучшая в своём классе программа-краулер для технического аудита сайта. Анализирует ресурс по десяткам параметров. С её помощью можно изучать страницы конкурентов, проводить пакетный анализ заданного списка URL, получать данные из Google Search Console и решать много других задач. Обязательный инструмент для SEO, к тому же с удобным интерфейсом.

Лицензия стоит 149 британских фунтов (около 15 тысяч рублей) в год. В бесплатной версии доступны все функции, но ограничено количество сканируемых страниц — до 500 URL. Большинство корпоративных сайтов, визиток, личных блогов впишутся в этот лимит.

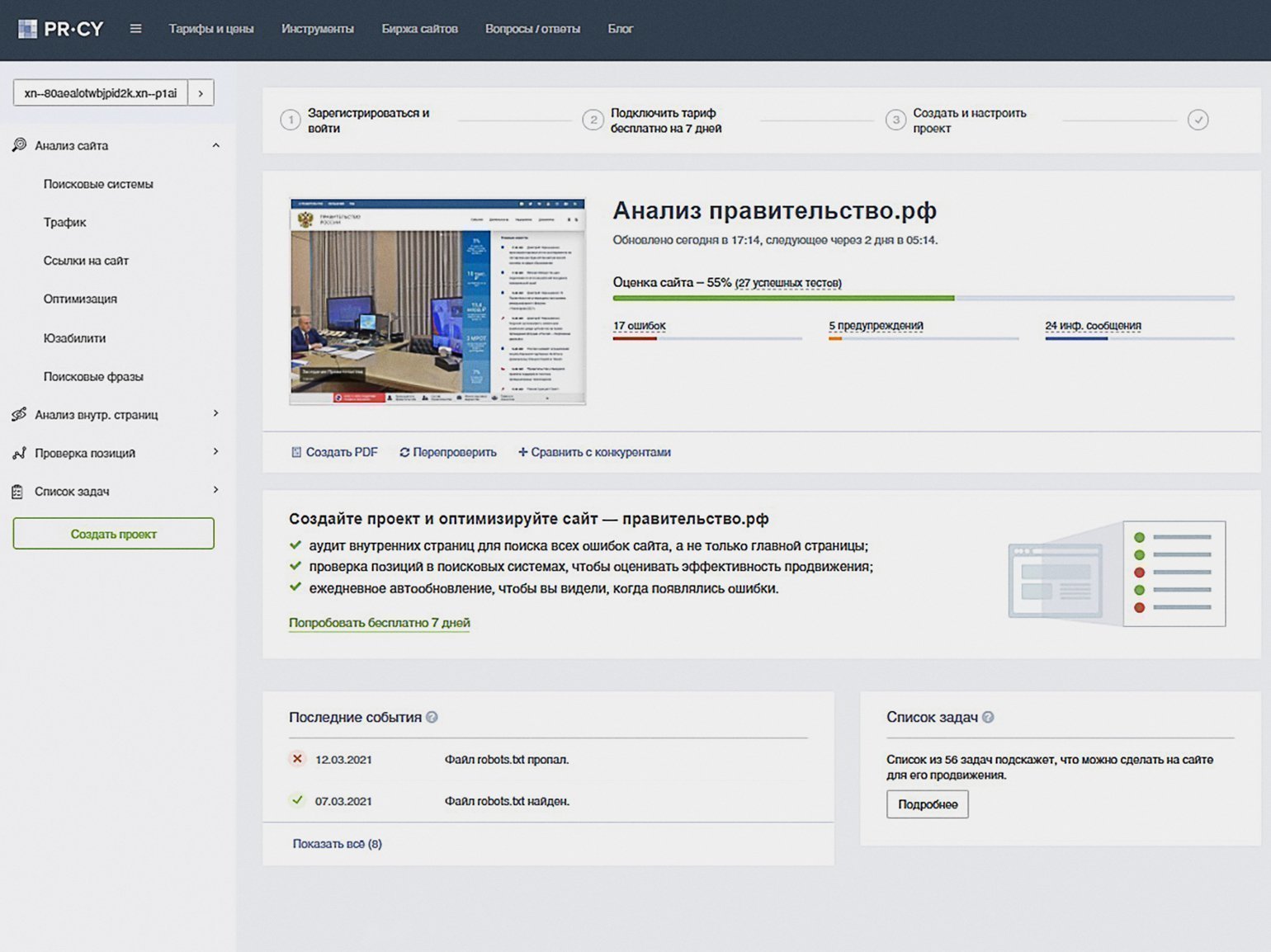

4. Анализатор от PR-CY

Проверяет сайт по нескольким десяткам показателей и создаёт отчёт за несколько минут. Подходит для быстрой оценки, в том числе при конкурентном анализе. Можно добавить сайт в панель и настроить регулярные автоматические проверки — это доступно зарегистрированным пользователям бесплатно.

5. Content-Watch

Сервис для проверки уникальности текста. Работает быстро, позволяет выполнять до трёх проверок в день бесплатно. Умеет проверять уникальность по URL, в том числе в пакетном режиме. Подключив платный тариф, можно проверить весь сайт и настроить регулярные проверки с заданным интервалом.

6. Iloveadaptive

Здесь можно быстро проверить, как сайт выглядит на смартфонах, планшетах и ноутбуках. Есть симуляторы наиболее популярных iOS/Android-устройств, а также гибкие настройки параметров отображения.

7. Google Lighthouse

Летом 2021 года Google начала постепенно включать в основной поисковый алгоритм набор факторов под названием Core Web Vitals. Это разработанные Google показатели (в выборку входит, например, стабильность вёрстки). Они нужны для оценки качества пользовательского опыта при взаимодействии с сайтом.

Google Lighthouse — это расширение для Chrome, которое позволяет быстро получить отчёт по Core Web Vitals. Достаточно ввести адрес целевого сайта.

8. GTmetrix

Сервис для проверки скорости загрузки сайта. Выдаёт более корректные результаты, чем PageSpeed Insights от Google. Вы получите не только данные о том, насколько быстро загружается страница, но и подробные рекомендации, которые помогут улучшить этот показатель. В отчёте есть даже ссылки на файлы, оптимизация которых ускорит работу сайта.

Но получить результаты сканирования, сделанного программой, — это только полдела. Нужно ещё правильно интерпретировать эти данные. Качественного результата можно достичь, только сочетая специализированные инструменты и ручной анализ.

Список пунктов, которые нужно проверить, может включать в себя десятки позиций. Разные специалисты и агентства предлагают разные варианты. Это также зависит от направления анализа, целей проверки и особенностей конкретного сайта.

В свой чек-лист я включил универсальные факторы, которые входят в любой SEO‑аудит. Это базовый список. Он подойдёт тем, кто проводит анализ самостоятельно.

- URL-адреса страниц корректны.

- Есть sitemap.xml и robots.txt, они правильно заполнены.

- Если сайт работает на HTTPS, то нет дублирования на HTTP (нет смешанного контента).

- На всех страницах есть метатеги Title и Description, они корректны.

- Контент уникален, особенно на посадочных страницах.

- Структура сайта (уровни вложенности, логика навигации) оптимизирована.

- На сайте нет битых ссылок.

- Настроены канонические страницы и перенаправления (301 редирект).

- Есть атрибут hreflang (как его использовать, можно прочитать здесь) для локализованных версий страниц.

- Сайт удобно использовать на мобильных устройствах.

- Нет дубликатов страниц, контента или метатегов.

- Хорошая скорость загрузки сайта.

- Сайт индексирован в панелях вебмастеров.

- Нет URL, выдающих ошибку 404.

- Нет штрафных санкций в панелях вебмастеров.

- Сайт проверен на основные коммерческие факторы ранжирования «Яндекса».

- Выполнена проверка пагинации: она корректно работает и индексируется, страницы пагинации уникальны.

- Заполнено содержимое атрибута alt для изображений.

- Изображения оптимизированы для ускорения загрузки.

- Выполнена проверка качества ссылочной массы сайта и используемых анкоров.

- Есть регистрация в «Google Мой бизнес» и «Яндекс.Справочнике» (для локального бизнеса).

- На страницах ресурса есть внешние ссылки на другие сайты, их количество достаточно.

- Выполнен анализ контента: качества и полноты наполнения.

В этот список не вошли базовые действия, такие как добавление сайта в Google Search Console и «Яндекс.Вебмастер», подключение веб-аналитики. SEO-аудит проводят для работающего сайта, где такие действия уже выполнены.

- Для чего нужно SEO и что туда входит: разбор для новичков

- 15 SEO-инструментов для решения любой задачи: от сбора ключей до анализа битых ссылок

- Гайд по работе с ключевыми фразами: сбор семантики, фильтрация, распределение, создание контента, метатеги

- Пошаговая инструкция: с чего начинать продвижение сайта

- Всё, что нужно знать о SEO-анализе текстов

Жизнь можно сделать лучше!

Освойте востребованную профессию, зарабатывайте больше и получайте от работы удовольствие. А мы поможем с трудоустройством и важными для работодателей навыками.

Посмотреть курсы

Инструкции

7 этапов базового анализа без привлечения сеошников

SEO-аудит сайта — это проверка на соответствие требованиям поисковых систем, которая поможет избежать проблем при продвижении сайта с нуля или найти причины резкого снижения трафика уже продвигаемого ресурса. В процессе аудита анализируем все важные параметры сайта, влияющие на рейтинг в поисковых системах, выделяем ошибки и слабые места, чтобы потом их исправить.

Специалисты агентства Kokoc.com рассказали:

- С чего начинать аудит, чтобы работа не прошла впустую.

- Какие факторы сейчас оказывают наибольшее влияние на ранжирование (процесс сортировки в выдаче поисковиков).

- Как самостоятельно провести SEO-анализ сайта с помощью инструментов Яндекса и Google, а также стороннего условно-бесплатного софта.

В конце — чек-лист для быстрой проверки сайта на SEO-оптимизацию.

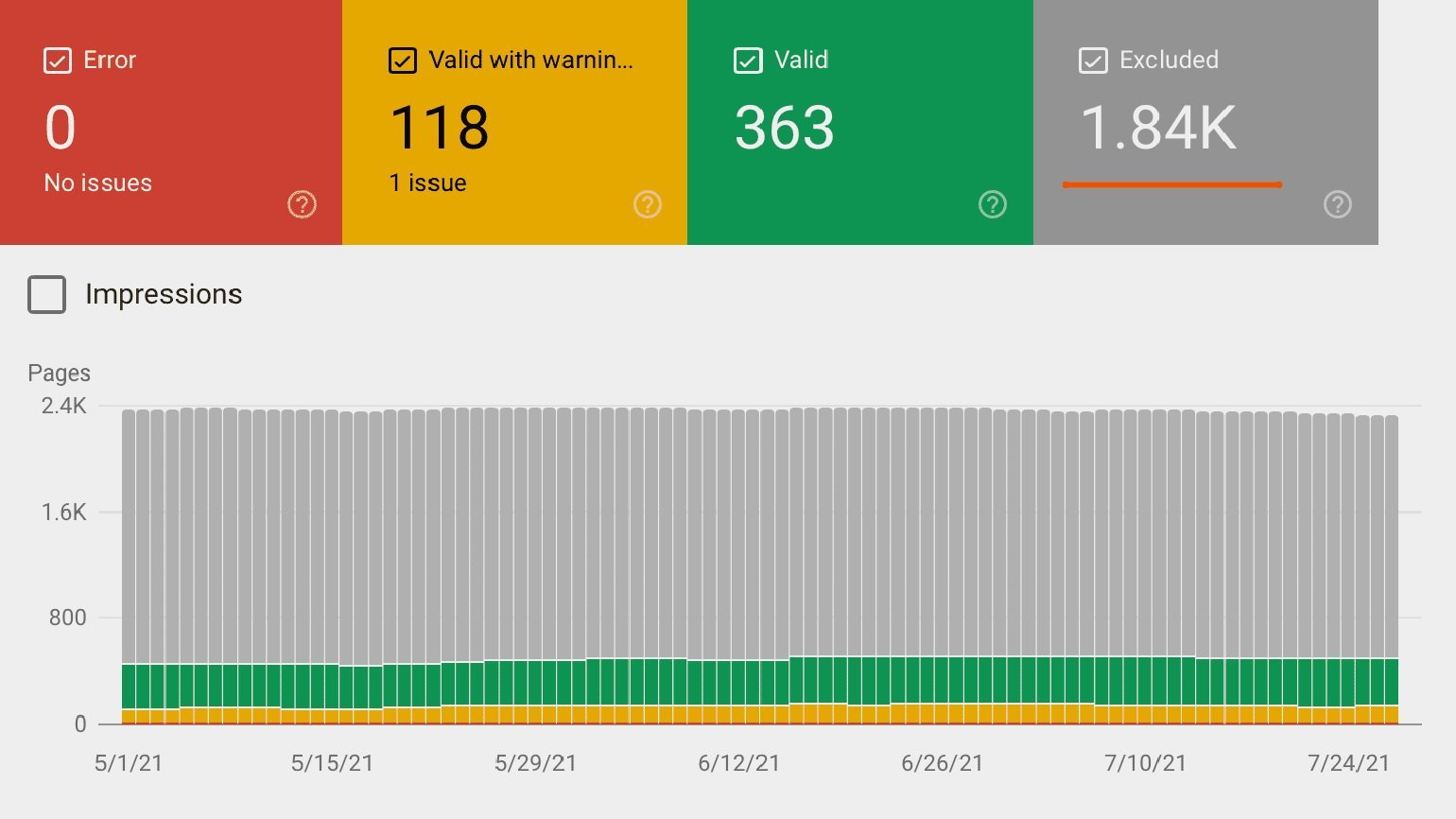

1. Проверьте индексацию сайта

Начать аудит стоит с проверки индексации (процесса сбора и добавления данных о страницах и контенте сайта в базы поисковых систем). Если есть проблемы, сайт нужно вернуть в выдачу — это самое важное. В Яндекс Вебмастере информация об индексировании сайта доступна во вкладке «Диагностика».

«Вебмастер» покажет общие проблемы сайта и даст рекомендации по исправлению

Следующий пунктом будет проверка индексации страниц в разделе «Индексирование» — «Страницы в поиске». Сильный разрыв между добавленными и исключенными страницами говорит о наличии проблем с индексацией.

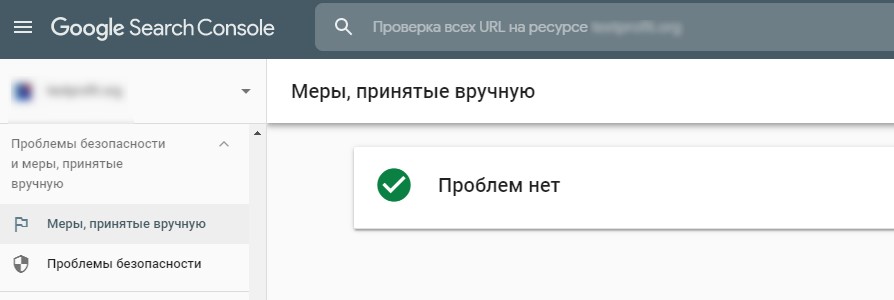

Аналогичную операцию нужно провести в Google Search Console — в отчетах «Проблемы безопасности» и «Меры, принятые вручную».

Система определит критические ошибки в индексировании и с безопасностью ресурса

Дальше нужно проверить индексацию страниц с помощью отчета «Покрытие». В нем можно найти страницы с ошибками или страницы, исключенные из индекса.

2. Выявите технические ошибки

Это следующий шаг после анализа индексации. Без решения технических неисправностей дальнейшие работы по SEO будут малоэффективны. Основные параметры и ошибки можно проверить через Яндекс Вебмастер и Search Console.

Ошибки в коде. Проанализировать корректность HTML-кода можно через службу Validation Service, а для проверки CSS там же есть инструмент CSS Validation Service.

Файл robots.txt. В разделе Яндекс Вебмастера: «Инструменты» — «Анализ robots.txt». Дубли страниц, корзина и административная панель не должны индексироваться.

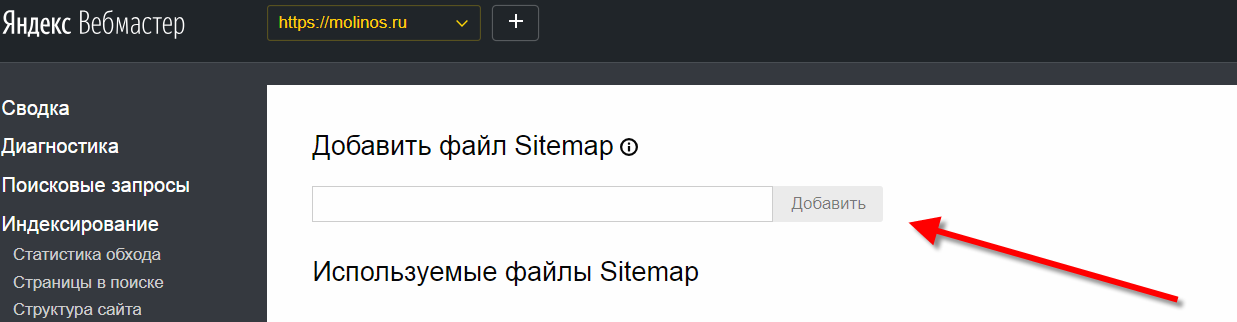

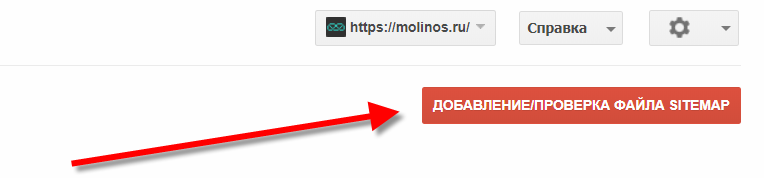

Файл sitemap.xml. Корректное заполнение карты сайта можно проверить в Яндекс Вебмастере: «Инструменты» — «Анализ файлов Sitemap».

Битые ссылки. Чтобы проверить наличие ссылок, которые написаны неправильно или ведут на несуществующие страницы, можно воспользоваться отчетом Вебмастера по адресу «Ссылки» — «Внутренние ссылки».

Несуществующие страницы. Определить страницы с ошибкой 404 можно в разделе Яндекс Вебмастера «Статистика обхода» или через отчет «Покрытие» в Google Search Console.

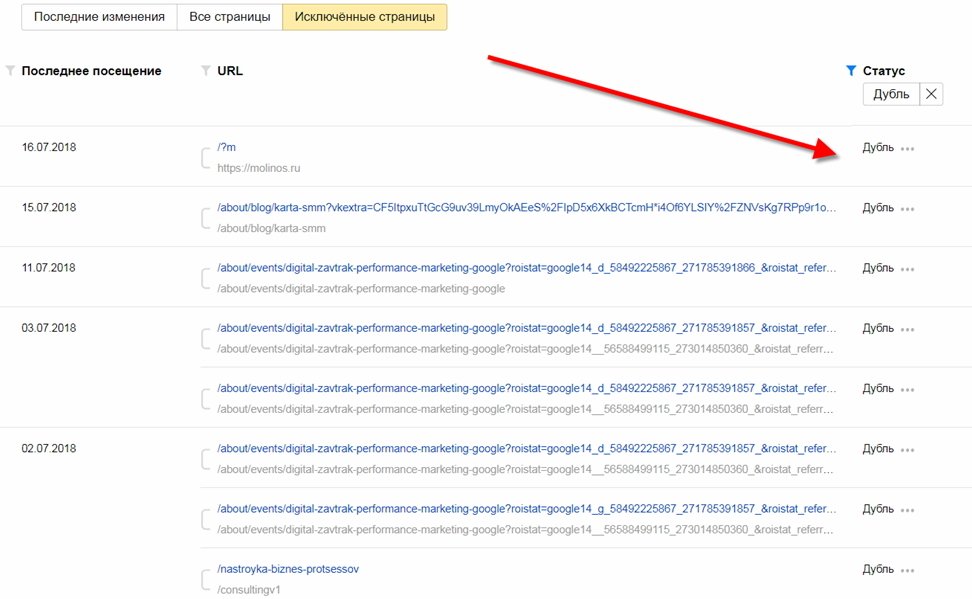

Дубликаты страниц. Чтобы найти страницы с одинаковым или очень похожим контентом, нужно перейти в раздел «Страницы в поиске» Яндекс Вебмастера. Отчет «Исключенные страницы» покажет все дубликаты на сайте.

Проблемы с микроразметкой. Для анализа микроразметки (дополнительных тегов и аргументов, которые помогают поисковым роботам лучше распознавать контент) в Яндекс Вебмастере нужно зайти в раздел «Инструменты» — «Валидатор микроразметки», а в Google Search Console воспользоваться сервисом «Проверка структурированных данных».

Адаптивная верстка. Проверить оптимизацию сайта под мобильные устройства можно в Яндекс Вебмастере в разделе «Инструменты» — «Проверка мобильных страниц». Или с помощью сервиса Google Mobile Friendly Test. В блоге Unisender разбирали и сторонние инструменты для проверки адаптивности.

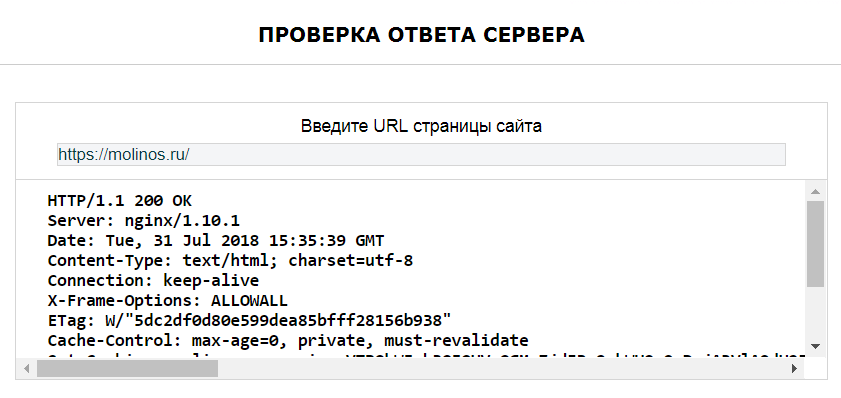

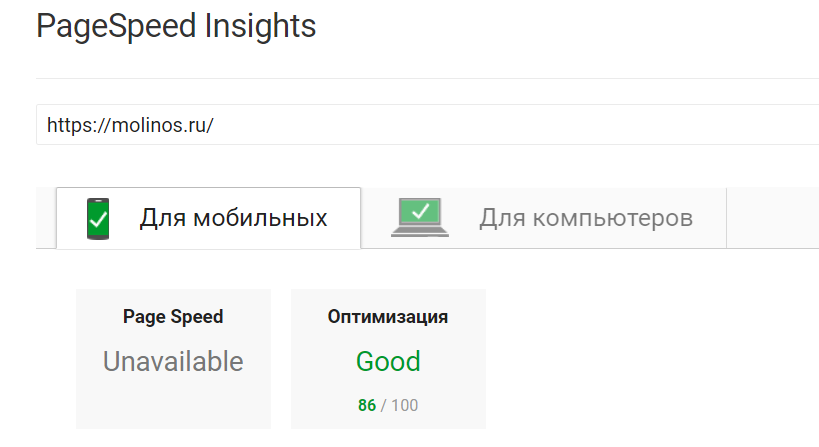

Скорость загрузки. В Яндекс Вебмастере ее можно измерить в разделе «Инструменты» — «Проверка ответа сервера», показатель не должен превышать 200 мс. Также для проверки можно использовать сервис Google — PageSpeed Insights, где скорость оценивается по 100-балльной шкале.

Человекопонятные URL. Все адреса должны быть прописаны транскрипцией или английским переводом, чтобы быть понятными для пользователей, и отражать наполнение страницы. При этом важно соблюдать вложенность URL-адресов согласно структуре сайта: каждая страница должна принадлежать своему разделу, товарная карточка — категории каталога.

Вебмастеры Яндекса и Google дают исчерпывающую картину данных о техническом состоянии сайта, но для быстрой проверки можно задействовать сторонние ресурсы: Pr-cy, Be1 или Sitechecker. Полная проверка сайта платная, зато результат будет быстрее и сразу по двум поисковым системам.

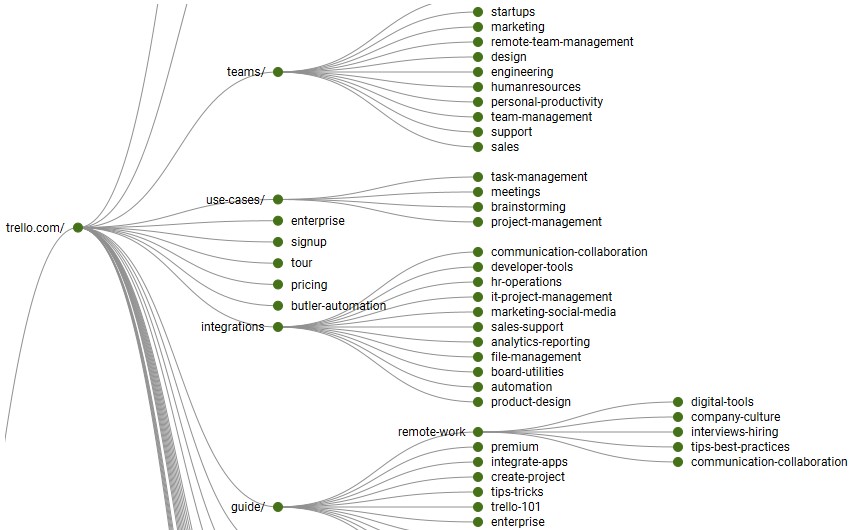

3. Просмотрите структуру сайта

Структура влияет на:

Ссылочный вес. Это обобщенная оценка качества и количества внешних ссылок, которые ведут на сайт. Чем больше других сайтов ссылаются, тем выше доверие поисковых систем.

Скорость работы краулеров. Это роботы поисковых систем, которые сканируют и индексируют сайт — благодаря ним он попадает в поисковую выдачу. Сайты с логичной структурой сканируются быстрее, чем ресурсы с большой вложенностью страниц, пустыми или закрытыми от индексации разделами.

Удобство навигации по сайту. Это улучшает поведение на сайте, а связанные с ним показатели (время на сайте, показатель отказов, глубина просмотра) сильно влияют на ранжирование Google, Yandex и других браузеров. Это главная причина, почему для выхода в топ стоит делать сайты с максимальной пользой для людей, а не поисковых роботов.

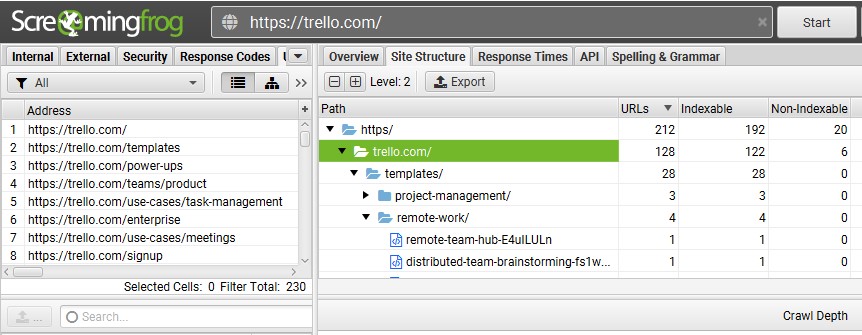

Для крупных ресурсов придется использовать платные решения: например, в Топвизоре сканирование многостраничного сайта обойдется в районе 150–500 ₽. Анализировать небольшие сайты удобно с помощью бесплатной версии Screaming Frog, которая просканирует до 500 страниц.

Для анализа достаточно вставить адрес сайта и запустить сканирование. Результат отображается во вкладке Site Structure

При проверке важно изучить:

Наполненность сайта. В структуру должны входить все кластеры семантического ядра (группы отсортированных поисковых запросов). Чем больше ключевых фраз покрывает ресурс, тем больше пользователей могут найти сайт в поиске и перейти по ссылке.

Логичность формирования разделов. Страницы должны соответствовать тематике разделов и подразделов, а структура — сохранять возможность логичного расширения. Товары и услуги должны размещаться в разных каталогах, а контент, оптимизированный под коммерческие и информационные запросы — на разных страницах. Это необходимо для корректного расширения ресурса при добавлении новых страниц, а также для удобного поиска контента и навигации по сайту.

Вложенность страниц. Путь от главной до страниц должен быть не больше 3–4 кликов. Это нужно для правильного распределения ссылочного веса и удобной навигации по сайту. Чем меньше вложенность страниц, тем быстрее пользователь будет перемещаться по сайту и находить нужный контент или товар.

Также при анализе структуры стоит проверить удобство меню и корректность хлебных крошек (вспомогательных элементов навигации, которые отображают цепочку ссылок, формируют полный путь ко странице сайта; с их помощью можно быстро перемещаться со страницы обратно в раздел или на главную).

Для комфортного анализа в Screaming Frog результаты сканирования можно визуализировать — во вкладке Visualizations нажать Directory Tree Graph. С готовой визуализацией удобно проверять хлебные крошки на многостраничных сайтах.

Через визуализацию данных удобно проверять уровень вложенности страниц и логику структуры

4. Оцените качество контента

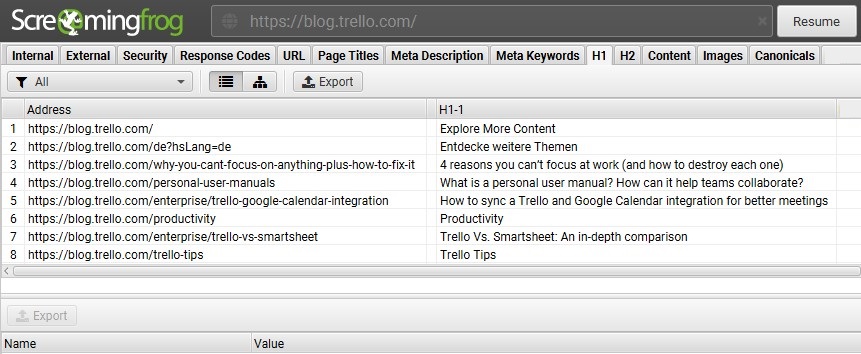

Можно начать с проверки корректности метатегов и заголовков страниц с помощью специального софта.

Для удобства теги и заголовки можно проверить в отчете Screaming Frog, который получили при анализе структуры

В результатах обратите особое внимание на страницы с одинаковыми или незаполненными тегами, с нарушением иерархии заголовков (например, когда отсутствует H1 или после H1 идет H3) или превышением количества символов в Title и Description. (В среднем, Title рекомендуют укладывать в 60–70 символов, а Description — до 150.)

Далее стоит заняться контентом. Его обязательно учитывают асессоры поисковых систем — специалисты, которые вручную проверяют сайты и влияют на ранжирование в поиске. Они обращают внимание на экспертность и авторитетность информации, а также ее соответствие поисковым запросам пользователей.

Во время аудита стоит обращать внимание на качество текста и изображений — форматирование и наполненность страниц, полезность опубликованных материалов, а также авторитетность используемых источников информации. Для грамотной и комплексной оценки контента на сайте лучше пригласить опытного редактора.

5. Изучите ссылочный профиль

Качество ссылочной массы влияет на уровень доверия к сайту — чем больше тематических сайтов ссылается на ресурс, тем выше доверие к нему у поисковых систем.

В GSC для анализа доступен отчет о ссылках. В Яндекс Вебмастере проверить профиль можно во вкладке «Внешние ссылки».

Количество исходящих ссылок должно быть меньше входящих, иначе есть риск получить санкции от поисковых систем

С помощью проверки можно проверить динамику прироста и содержание ссылочной массы. А при использовании сторонних сервисов (Xtool, Backlink Watch или др.) результаты из Вебмастера можно сравнить с количеством входящих ссылок у конкурентов. Это поможет примерно оценить, сколько и каких ссылок нужно получить для выхода на интересующую позицию в выдаче.

6. Исследуйте поведенческие факторы

Поведенческие факторы отражают соответствие сайта ожиданиям пользователей. Если не сразу уходят, проводят много времени на сайте, переходят на другие страницы — скорее всего, поисковики оценят ресурс как релевантный и поднимут его повыше.

Базовая информация о поведенческих факторах — таких показателях, как время на сайте, отказы, глубина просмотра — доступна сразу в сводке Яндекс Метрики. (Если счетчик не установлен, в блоге Unisender можно прочитать, как подключить и настроить Метрику.)

Количество визитов, процент отказов и глубина просмотра отражают удовлетворенность пользователей сайтом

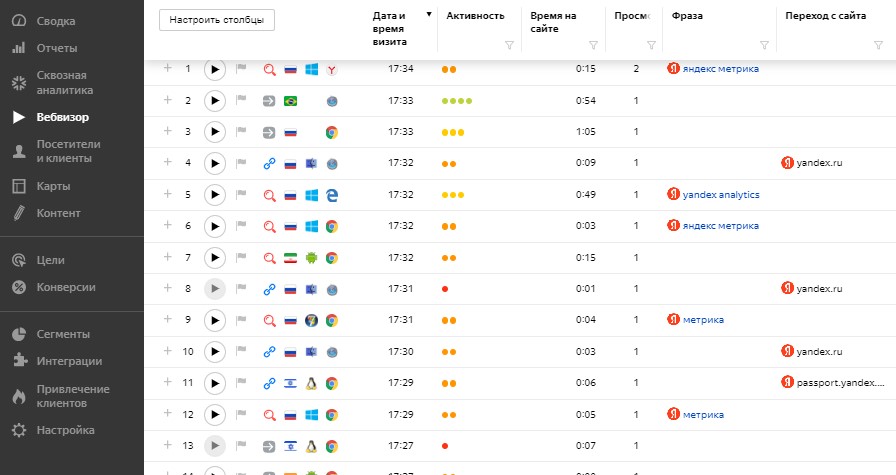

Через инструмент «Вебвизор» в Яндекс Метрике можно посмотреть на сайт глазами потенциальных клиентов.

В «Вебвизоре» можно просмотреть полный путь взаимодействия каждого пользователя с сайтом

Google меньше внимания уделяет поведенческим факторам и использует для оценки технические параметры, определяющие удобство просмотра контента на странице. Сюда входят скорость загрузки, адаптация под мобильные устройства, поддержка HTTPS.

Также отслеживание поведенческих факторов есть в Google Analytics — в обзорных отчетах из раздела «Поведение»

7. Анализируйте коммерческие факторы

Единственное в SEO, что нельзя проверить софтом, — это коммерческие факторы. Они показывают доступность и удобство сайта для выбора товаров и оформления покупок.

Перечислим наиболее значимые коммерческие факторы, влияющие на ранжирование:

Контакты и способы связи. Помимо адреса, контактов и подключенных чат-ботов, асессоры учитывают все мелочи, которые упрощают связь с клиентами. Сюда можно отнести номера менеджеров, наличие схемы проезда, время работы и т.д.

Товарная матрица и ассортимент. Важно, чтобы ассортимент был широким или примерно равным предложению прямых конкурентов, а количество товаров со статусом «Нет в наличии» не превышало 10% от каталога.

Карточки товаров и услуг. Влияют качество и количество фото и видео, описание карточек, наличие товаров, отображение цен и валюты, удобство кнопок, ведущих к транзакции.

Сведения о компании. То есть лицензии, отзывы покупателей на сайте, портфолио, страницы с сотрудниками и историей бренда. Чем больше данных могут подтвердить хорошую репутацию бренда, тем лучше для ранжирования.

Пример проработки коммерческих факторов на сайте Kokoc.com: блоки на странице, которые помогут клиенту принять решение о покупке

Формально к коммерческим факторам можно отнести все, что влияет на совершение покупок. Поэтому нужно отслеживать проблемы, мешающие транзакциям, и постоянно прокачивать сайт, делать его более удобным для пользователей.

Чек-лист: как провести SEO-аудит сайта самостоятельно

Для полного анализа важно пройти все этапы и выписать выявленные проблемы в отдельный файл — это станет основой для ТЗ на доработку и SEO-оптимизацию сайта.

- Ошибки и санкции в Яндекс Вебмастере — «Диагностика».

- Индексация страниц в Яндекс Вебмастере — «Индексирование» — «Страницы в поиске».

- Ошибки безопасности в Google Search Console— «Проблемы безопасности» и «Меры, принятые вручную».

- Индексация страниц в Google Search Console — отчет «Покрытие».

- Ошибки HTML через Validation Service.

- Ошибки CSS через CSS Validation Service.

- Корректность robots.txt в Яндекс Вебмастере — «Инструменты» — «Анализ robots.txt».

- Корректность sitemap.xml в Яндекс Вебмастере — «Инструменты» — «Анализ файлов Sitemap».

- Битые ссылки в Яндекс Вебмастере — вкладка «Ссылки» — «Внутренние ссылки».

- Несуществующие страницы в Яндекс Вебмастере — «Статистика обхода». Или в Google Search Console — отчет «Покрытие».

- Дубликаты страниц в Яндекс Вебмастере — «Страницы в поиске» — отчет «Исключенные страницы».

- Наличие микроразметки в Яндекс Вебмастере — «Инструменты» — «Валидатор микроразметки». Или в Google Search Console — «Проверка структурированных данных».

- Адаптивная верстка в Яндекс Вебмастере — «Инструменты» — «Проверка страниц для мобильных». Или в Google Search Console — Mobile Friendly Test.

- Скорость загрузки в Яндекс Вебмастере — «Инструменты» — «Проверка ответа сервера». Или PageSpeed Insights от Google.

- ЧПУ URL — адреса в транскрипции или английском переводе, отражают наполнение страницы, соблюдена вложенность URL-адресов согласно структуре сайта.

- Структура сайта — Топвизор для многостраничных сайтов или Screaming Frog для небольших, до 500 страниц.

- Метатеги и заголовки — отчеты Screaming Frog, вкладки Meta, H1–H2, Content и Images.

- Ссылочный профиль в Яндекс Вебмастере — «Внешние ссылки». Или в Google Search Console — отчеты по ссылкам.

- Поведенческие факторы в Яндекс Метрике — «Сводка». Или в Google Analytics — «Поведение».

- Коммерческие факторы — связь с клиентами, ассортимент, карточки товаров, информация о компании. Должны быть проработаны все точки взаимодействия с клиентами и моменты, которые могут повлиять на покупку.

Для проведения полного базового аудита будет достаточно штатных инструментов Яндекса и Google, а также бесплатной версии Screaming Frog. На анализ и составление рекомендаций для небольшого сайта уйдет не больше 3–4 часов.

Поделиться

СВЕЖИЕ СТАТЬИ

Другие материалы из этой рубрики

Не пропускайте новые статьи

Подписывайтесь на соцсети

Делимся новостями и свежими статьями, рассказываем о новинках сервиса

«Честно» — авторская рассылка от редакции Unisender

Искренние письма о работе и жизни. Свежие статьи из блога. Эксклюзивные кейсы

и интервью с экспертами диджитала.

HTML

Первостепенные задачи, стоящие перед специалистом по SEO – это всестороннее изучение контента, структуры, технических особенностей сайта и влияющих на него внешних факторов, выявление слабых мест, планирование и реализация необходимых доработок, с учетом всех принципов работы поисковых систем. А самое главное, что проводить такой анализ и оптимизацию нужно регулярно, ведь поисковые алгоритмы постоянно совершенствуются, и многие тактики SEO устаревают и перестают работать.

Несмотря на то, что максимально высоких результатов SEO-аудита вы сможете добиться, только прибегнув к сотрудничеству с профессионалами, вы и сами можете многому научиться, используя нижеописанное руководство, ссылки на внешние материалы и инструменты SEO, которые вы найдете во второй половине статьи. Для вашего удобства, все инструменты в статье кликабельные. На протяжение всей статьи будут упоминаться инструменты Яндекса и Google, как самые главные и удобные инструменты для поискового продвижения.

Этап 1. Подготовка к SEO-аудиту

Лучше всего начать со сканирования сайта, используя краулер (поисковый робот), например, Screaming Frog SEO Spider. Этот инструмент анализирует код, контент, внутренние и исходящие ссылки, изображения и другие элементы сайта с точки зрения SEO и составляет общее представление о положении дел.

Нельзя забывать о возможностях стандартных сервисов поисковых систем — Яндекс.Вебмастер и Google Webmaster Tools – они так же предоставляют большое количество ценной информации.

Этап 2. Внутренний SEO-аудит

Технический аудит

Robots.txt

Файл robots.txt по желанию размещается в корневой директории сайта и содержит инструкции по его индексированию для роботов поисковых систем.

С использованием различных директив robots.txt можно:

- запретить или разрешить роботам индексировать некоторые разделы и страницы сайта или весь сайт целиком;

- указать путь к карте сайта sitemaps.xml, способствующей правильному индексированию;

- дать понять роботу, какое зеркало сайта, при наличии нескольких его копий, является главным, и какие зеркала индексировать не нужно;

- снизить нагрузку на сайт от поисковых роботов, если необходимо экономить ресурсы.

При этом разные правила можно создавать для отдельных поисковых систем и даже для разных роботов одной и той же системы.

Используйте все возможности robots.txt. Убедитесь, что запрещено индексирование «секретных» областей сайта, страниц с контентом низкого качества и страниц-дубликатов. Проверьте, разрешен ли доступ ко всем областям сайта, которые должны быть проиндексированы поисковыми системами.

При анализе файла robots.txt вам помогут Яндекс.Вебмастер, Google Webmaster Tools и другие сервисы.

Указания для поисковых роботов в тэгах

Но для еще более гибкого управления индексированием сайта и его отдельных страниц поместите директивы для поисковых роботов в тэгах.Так вы разрешите или запретите роботам индексирование конкретных страниц и переход по размещенным на них ссылкам.

XML Sitemap

Файл Sitemap (карта сайта) добавляется в корневую директорию сайта и дает поисковым системам информацию о том, какие страницы сайта должны быть проиндексированы, какие из них в первую очередь, как часто они обновляются.

Если на сайте уже есть файл Sitemap (желательно в формате XML), то проверьте корректность его кода с помощью валидатора (такой инструмент есть, в частности, в сервисах для веб-мастеров от Яндекса и Google). Позаботьтесь также о том, чтобы файл Sitemap содержал не более 50 тыс. URL и весил не более 10 Мб. Если эти лимиты превышены, то придется создать несколько файлов Sitemap и один индексный файл Sitemap Index со списком всех карт.

Если карты сайта пока нет, создайте ее вручную или с помощью одного из множества инструментов (например, XML Sitemap и его аналогов, плагинов для WordPress и других распространенных движков; с большим списком инструментов можно ознакомиться на ресурсах Google).

После создания проанализируйте карту в валидаторе и сообщите поисковым системам о ее существовании через их сервисы для веб-мастеров, а также посредством добавления пути к Sitemap в файл robots.txt.

Markup Validator – валидатор html-кода для устранения неточностей и ошибок кода, снижающих позиции сайта в выдаче. Создан сообществом, которое занимается разработкой и утверждением международных стандартов веб-разработки.

Оценка качества индексирования сайта

Команда site: обычно вводится в строке поисковых машин, чтобы ограничить зону поиска определенным доменом. Но эта команда позволяет также узнать приблизительное количество всех страниц сайта, которые были проиндексированы. Для этого просто введите site: c доменным именем без слов поискового запроса.

Сравните количество проиндексированных страниц с общим количеством страниц сайта, которое вы узнали на стадии создания sitemap.xml и сканирования сайта с помощью Screaming Frog, Xenu’s Link Sleuth или других инструментов.

Если оба числа почти одинаковы, значит, сайт проиндексирован хорошо. Если проиндексированы не все страницы, то выясните причину — возможно, ваш сайт не оптимизирован для поисковых систем, имеет много закрытых от индексирования разделов и страниц или попал под санкции. Если же количество проиндексированных страниц превосходит реальное их количество, то, вероятно, на вашем сайте есть много дублированного контента, о котором речь пойдет далее в этой статье.

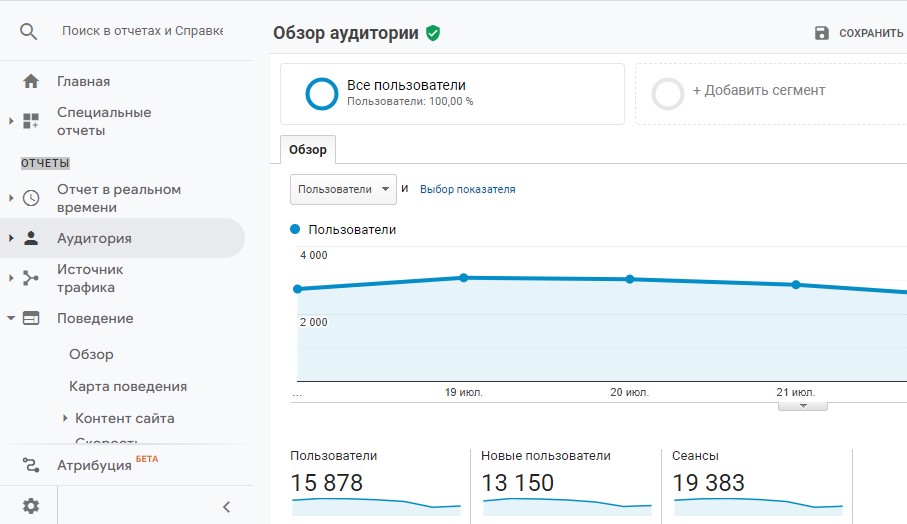

Рассмотрим подробнее, как работает и что показывает Google Webmaster Tool.

При его открытии отображается подобный график:

Он показывает, сколько страниц проиндексировано в настоящий момент. На графике отображены данные за последний год.

И если на нем видно, что количество проиндексированных страниц постоянно увеличивается, то это замечательно. Это означает, что новый контент на сайте находится, ранжируется и добавляется в индекс Google.

Но иногда необходимо получить более подробную информацию. Для этого есть кнопочка «Расширенные данные». После нажатия на нее, открывается новый график:

На нем отображается не только количество проиндексированных страниц на данный момент времени, но и общее количество – те которые были просканированы за весь показанный период. Также показывается число страниц, заблокированных в файле robots.txt и страницы, которые не попали в индекс.

Коды состояния HTTP

Код состояния HTTP – это часть первой строки ответа сервера при запросах по протоколу HTTP. Он представляет собой целое число из трех арабских цифр, находящееся впервой строке ответа сервера при запросе к веб-странице, и показывает ее текущее состояние. Необходимо установить, при обращении к каким URL сайта появляется сообщение об ошибке— обычно с кодом вида 4xx или 5xx. Например, известно: код 404 означает, что страница не найдена, а код 503— что обнаружена внутренняя ошибка сервера. Код 200 говорит о том, что все работает хорошо.

Если на сайте используются перенаправления (редиректы) с одних URL на другие, то убедитесь, что это именно 301 редиректы, а не 302 и не перенаправления, прописанные в тегах или с помощью JavaScript. Используя 302 redirect (Temporary redirect) — «временно перемещен» – вместо 301, исходный URL будет оставаться в индексе Google, и удерживать свои позиции, как если бы страница все еще была доступна. Однако пользователи, которые будут кликать на ссылке, попадут на ваш новый URL – именно туда, куда вы намерены их направить.

Для проверки кодов состояния HTTP можно пользоваться различными сервисами— например, специальным инструментом от Monitor Backlinks или встроенными средствами Яндекс.Вебмастер и Google Webmaster Tools.

URL страниц сайта

Грамотный URL страницы имеет длину не более 100-120 символов,состоит в основном из легкочитаемых слов (например, вот такой: https://myacademy.ru/kursi/seo-poiskovaya-optimizatsiya/seo-dlya-nachinayuschih — содержит ключевые слова, описывающие страницу.

Все это способствует не только лучшему поисковому индексированию, но и повышению удобства для посетителей сайта.

Старайтесь избегать сложных адресов с параметрами и отдавать предпочтение статичным ссылкам, использовать для разделов в структуре сайта директории, а не субдомены, разделять отдельные слова в URL дефисами или знаками подчеркивания, такое написание лучше воспринимается посетителями сайта.

Скорость загрузки сайта

Пользователи интернета нетерпеливы и сразу покидают медленные сайты. Так же и у поисковых систем есть определенный лимит времени на обработку каждого сайта, поэтому быстрые сайты индексируются тщательнее и за более короткий период времени.

Как проанализировать скорость загрузки сайта?

Применяйте встроенные средства систем веб-аналитики (например, отчеты о времени загрузки страниц есть в Google Analytics и Яндекс.Метрике. А для наиболее полного анализа скорости можно использовать специализированные сервисы, например, Google PageSpeed Insights:

или YSlow:

Если сайт нуждается в ускорении, оптимизируйте изображения в графическом редакторе с помощью функции подготовки графики для публикации в интернете, сократите объем кода HTML и CSS, уберите лишний код JavaScript, разумно используйте сжатие, кэш браузера и сервера и осуществите другие необходимые действия.Этап 3. Аудит структуры сайта

Архитектура сайта

Сайт должен иметь ясную и логичную структуру страниц, упорядоченных по категориям и тесно связанных между собой внутренними ссылками.

Избегайте большого количества уровней вложенности: пусть все важные страницы будут расположены водном клике от главной, а другие страницы — не далее, чем в 3-4 кликах.

Такая простая для посетителя архитектура сайта позволит поисковым машинам быстрее проиндексировать все страницы сайта, а посетителям поможет не заблудиться и быстро найти нужную информацию, что, в конечном счете, тоже положительно повлияет на SEO.

Старайтесь не использовать на сайте навигационные меню, созданные с помощью Flash иJavaScript. Это нежелательно, даже несмотря на то, что поисковые системы сегодня намного умнее, чем в прошлом.

Если все же JavaScript-навигация присутствует на сайте, проведите два этапа индексирования сайта с помощью Screaming Frog, Xenu’s Link Sleuth или другого специализированного сервиса (мы писали об этом в начале этого руководства): с включенным и отключенным JavaScript. Это позволит выявить, оказались ли какие-то разделы и страницы сайта недоступными для индексирования из-за наличия JavaScript-меню.

Внутренние ссылки

Внутренняя перелинковка способствует лучшему индексированию сайта и разумному распределению веса страниц.

В этом нелегком деле поможет Page Rank Decoder – инструмент для прогнозирования распределения веса страниц при использовании различных схем перелинковки.

Установите между страницами сайта множество связей, соблюдая при этом простые требования:

- в качестве анкоров используйте не только ключевые слова, но и различный нейтральный текст— например, такие призывы к действию, как «ознакомьтесь», «скачайте» и т.п. (это делает общую массу ссылок более естественной для поисковых систем, тогда как изобилие ключевых слов выглядит подозрительно);

- страницы и ключевые слова в составе анкоров должны быть релевантны контенту целевых страниц;

- направляйте больше ссылок на те страницы, которые должны занять более высокие позиции;

- ссылайтесь на такие страницы с«Главной»;

- не размещайте на одной слишком большое количество внутренних ссылок.

Этап 4. Аудит контента

Заголовки страниц

Заголовки страниц – это первое, что видит ваша аудитория в поисковой выдаче и в социальных сетях, после чего они принимают решение посетить ваш сайт. Поэтому важно уделить оптимизации заголовков особое внимание.

Формулируйте заголовки кратко: старайтесь не выходить за рамки 70-90 символов,иначе заголовок может быть обрезан в результатах поиска, в социальных сетях, а пользователи Twitter не смогут добавить кн ему свои комментарии.

Заголовки служебных и различных информационных страниц сайта (за исключением статей и других подобных контентных продуктов) должны точно описывать их содержание.

Не забудьте добавлять в заголовки страниц ключевые слова – желательно ближе к началу. Но не переходите границы разумного: как и в случае со всем контентом страницы, придумывайте заголовки для людей, а не для машин.

Убедитесь, что все страницы на сайте имеют уникальные заголовки. В этом вам поможет, например, сервис Google Webmaster Tools, в котором есть инструмент поиска страниц с одинаковыми заголовками.

Описания страниц в тэгах

Описание страницы из тэга может включаться в сниппет в поисковой выдаче, поэтому стоит ответственно подойти к управлению мета-описаниями важных страниц

Сниппет – это блок информации о найденном документе, который отображается в результатах поиска. Сниппет состоит из заголовка и описания или аннотации документа, а также может включать дополнительную информацию о сайте.

Составляйте описания из нескольких слов, общей длиной до 150-160 символов. Это должен быть связный текст, рассказывающий о конкретной странице, а не обо всем сайте, и не перегруженный ключевыми словами. Поддерживайте описания в актуальном виде: если информация на странице обновилась, и описание устарело, внесите в него необходимые изменения.

Пусть каждая страница имеет уникальное описание. Выявить все страницы с одинаковой информацией в тегах

можно с помощью Google Webmaster Tools.

Ключевые слова в тэгах

Уже достаточно давно большинство поисковых систем игнорируют ключевые слова в тэгах, так что есть смысл вообще не добавлять эту информацию в код сайта, чтобы не предоставлять конкурентам лишние данные о вашей SEO-стратегии.

Контент

Эта истина уже банальна, но: вы должны создавать контент для людей, а не для поисковых машин. Не стоит слишком увлекаться поисковой оптимизацией — это сделает текст почти непригодным для комфортного чтения и, в конечном счете, отрицательно скажется на результатах SEO.

Убедитесь, что страницы вашего сайта содержат ценный для аудитории, уникальный контент, а не сверхоптимизированный текст и копии с других сайтов, и что объем контента на каждой странице превышает 300-400 слов (есть данные, что при прочих равных условиях страницы с 2000 слов и более располагаются обычно выше в результатах поиска). В современных алгоритмах оптимальный объем контента автоматически формируется для разных тематик. В некоторых тематиках будет достаточно и 200-400 слов на странице, а кое-где понадобятся большие тексты. Если к вопросу подходить очень серьезно, то объем контента для каждой страницы определяется анализом выдачи по конкретным запросам в конкретном регионе.

Здесь вам на помощь придут такие сервисы:

ContentMonster

Биржа контента. Проверяет уникальность текста, следит за качеством работы авторов, возвращает 120% стоимости текста, если вы сочтете его некачественным.

Webartex

Объединяет биржу статей и сервис статейного продвижения. Копирайтеры напишут статьи под ваш проект, вебмастера разместят статьи с вечными ссылками на надежных площадках.

Content-Watch

Инструмент для проверки уникальности текстового контента. Позволяет проверить уникальность текста, введенного пользователем, и уникальность контента вашего сайта.

Advego Plagiatus

Бесплатный софт для проверки уникальности текстов. Показывает процент совпадения, источники текста. Проверяет тексты и веб-страницы.

Обратите внимание на наличие ключевых слов в тексте страниц — прежде всего, в первых нескольких абзацах. Отредактируйте текст так, чтобы использование ключевых слов не приводило к повторениям и бессмысленным фразам, написанным с одной лишь целью в очередной раз упомянуть ключевое слово. Красивый, стройный, полезный текст, с незаметными для читателя ключевыми словами — вот к чему вы должны стремиться.

Само собой разумеется, что нужно позаботиться, чтобы текст на сайте был лишен грамматических ошибок: безграмотность говорит о непрофессионализме автора, поэтому такой контент будет занимать низкие позиции в результатах поиска.

В этом вам помогут такие сервисы, как:

Орфорграф – один из самых первых сервисов проверки орфографии, который предложил рунету Артемий Лебедев.

Проверка орфографии от Яндекс.Вебмастер – обрабатывает веб-страницу целиком. Проверять правописание на Яндексе важно с точки зрения написания неологизмов. Как писать: «Твиттер» или «Твитер»? Яндекс расскажет, в каком виде его робот скорее распознает спорные слова.

Дублированный контент

Если на вашем сайте или за его пределами присутствует контент, дублирующий другие материалы сайта, поисковые системы должны определять, какую именно версию проиндексировать и показать в результатах поиска. И эта проблема только усугубляется по мере того, как другие сайты ссылаются на разные копии страницы или одну и ту же страницу, открывающуюся по разным URL.

Вот некоторые причины возникновения дублированного контента:

- CMS сайта может делать одни и те же страницы доступными по разным ссылкам;

- вторая часть URL на многих сайтах формируется динамически, содержит дополнительные параметры, меняющиеся в зависимости от различных факторов;

- контент сайта часто воруют, размещают на других ресурсах без обратной ссылки, и поисковая система не способна связать его с первоисточником;

- при посещении сайта может создаваться сессия с уникальным идентификатором, который используется в динамических URL (это нужно, например, для временного хранения информации о добавляемых в корзину товарах – вплоть до оформления заказа);

- версии страниц сайта, оптимизированные для печати, могут расцениваться как дубликаты.

Дублированный контент внутри сайта можно выявлять, например, с помощью Google Webmaster Tools (сервис умеет находить страницы с одинаковыми заголовками и мета-описаниями) и поисковых операторов, которые могут указываться вместе с запросами в строке поисковых машин.

Решить проблему дублированного контента можно путем простого удаления дубликатов, создания 301 редиректов, запрета на индексирование дубликатов в файле robots.txt или в мета-тэгах отдельных страниц, использования директивы rel=»canonical» и другими способами.

Внутритекстовые заголовки

Четко структурируйте текстовые публикации. Используйте заголовки (тэг – для самых значимых из них), подзаголовки нескольких уровней, выделяйте отдельные фрагменты текста жирным шрифтом, курсивом.

В идеале на странице должен присутствовать всего один заголовок первого уровня, который содержит в себе два-три заголовка второго уровня, в которых, в свою очередь, «вложены» заголовки рангом поменьше и так далее. Структура документа должна иметь примерно такой вид:

При этом важно соблюдать меру: слишком много заголовков и ключевых слов, выделенных жирным шрифтом, оттолкнут читателей не меньше, чем монотонный неструктурированный текст. Продуманное форматирование текста значительно облегчает читателю восприятие текста, а заголовки с важными словами еще и положительно сказываются на SEO. А наилучший способ структурирования текстов на сайте – думать, прежде всего, о людях и сделать несколько легких «реверансов» в сторону поисковых машин.

Изображения

Часто посетители ищут информацию по картинкам, и таких пользователей очень много. Google и Яндекс предоставляют всем желающим поиск по картинкам, где с помощью ключевых слов каждый может найти нужные изображения.

А если есть поиск, значит, есть и трафик, который можно использовать в своих целях. Правильная оптимизация изображений под поисковые системы позволит привести на сайт трафик и усилить позиции документов по продвигаемым запросам.

Самые главные атрибуты картинок это ALT и Title. Загружая картинку к посту, нужно лишь прописать эти атрибуты и ваши картинки приведут посетителей.

Для этого проанализируйте все важные изображения на вашем сайте, тематически связанные с окружающим их текстовым контентом. Для полноценного индексирования имен графических файлов, а также значение атрибута alt тега должны содержать слова, описывающие изображение, и желательно ключевые слова страницы. При этом сделайте разными имя файла и значение атрибута alt.

Слова в имени файла стоит разделять дефисами, а не знаками подчеркивания. Для описания следует использовать именно атрибут alt, а не title, и оно должно быть кратким – не длиннее 150 символов, со всеми важными словами в начале текста.